2026年04月20日 06時00分

AI

Anthropicは2026年4月7日にサイバー攻撃性能が高すぎるAI「Claude Mythos Preview」を一部の重要ソフトウェア開発元向けに提供していると発表しました。こうした動きを受けて、技術系の論考を執筆しているDrew Breunig氏は、AI時代のセキュリティについて自らのサイトで論じています。

Cybersecurity Looks Like Proof of Work Now

https://www.dbreunig.com/2026/04/14/cybersecurity-is-proof-of-work-now.html

AnthropicがClaude Mythos Previewの高い能力を強調したことについて、セキュリティ分野ではAIが脆弱性を見つけたかどうかを後から比較的確かめやすく、大量のトークンを使わせれば印象的な成功例も作りやすいため、Breunig氏は当初Anthropicの説明を少し慎重に見ていたそうです。

しかし、その後イギリス政府のAI Security Institute(AISI)が、「Claude Mythos Previewはサイバー分野の性能においても従来モデルを一段上回る」と評価しました。

「Claude Mythos Preview」はネットワーク完全乗っ取り攻撃を自律的に実行できてしまうことがイギリス政府機関のテストで判明 – GIGAZINE

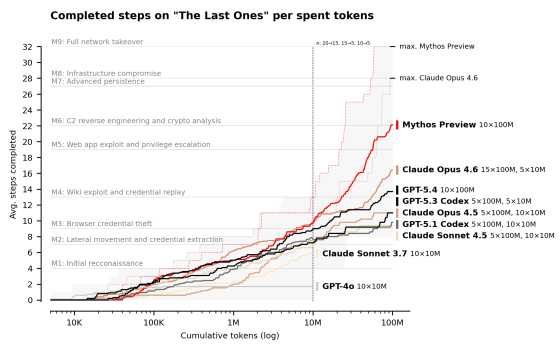

この評価を受けてBreunig氏はAnthropicの主張を軽視できなくなったといいます。Breunig氏が特に重視したのが企業のネットワークに攻撃をしかける場面を再現した「The Last Ones」のテストで、相手の情報を探る段階からネットワーク全体を乗っ取る段階まで、全部で32個の課題を用意したものです。

テスト対象のAIモデルはClaude Mythos PreviewやGPT-5.4など多岐に渡り、1回のテストごとに1億トークンを費やすまで処理が継続されました。テストの結果、1億トークン以内に32個の課題を完遂したのはClaude Mythos Previewのみで、10回のテストで計3回全課題をクリアしています。

AnthropicはClaude Mythos Previewを100万トークン当たり入力25ドル(約3980円)、出力125ドル(約1万9900円)で提供しています。AISIの評価では1回のテストごとに最大1億トークンが使われているため、この条件だと10回のテストで約1万2500ドル(約199万円)かかる計算になります。また、AIモデルはタスクが長引くと成果が頭打ちになりがちですが、AISIによると、Claude Mythos Previewは1億トークンに到達した時点でも成果の伸びが衰えなかったことがあったことが確認されています。

このような評価を踏まえてBreunig氏は、「システムを守る側は攻撃者が脆弱性を悪用する前に、AIにより多くのトークンを使わせて脆弱性を見つけなければならない」と主張し、さらにここから2つの帰結を導いています。

1つ目は、オープンソースソフトウェアの重要性はむしろ増すという点です。LiteLLMやAxiosでは、ライブラリの配布や更新の経路を通じて悪意あるコードが入り込む問題が起きました。そのため、外部ライブラリに頼る構成を見直し、必要な機能は大規模言語モデルにコードを書かせて自前で持つべきだという考えも出てきたとBreunig氏は述べています。

ただし、Breunig氏はそこから単純に「依存関係を捨てるべきだ」とは考えていません。企業がオープンソースのライブラリに対して十分なトークンを投じて監査するなら、個別に自前実装するより安全になる可能性があるとBreunig氏は述べています。一方で、広く使われるオープンソースソフトウェアは攻撃者にとっても価値が高いため、その分攻撃側が投じる額も増えるかもしれないと留保しています。

2つ目は、AIエージェントでコードを書く時代には、ソフトウェア開発の作業が「開発」「レビュー」「安全性の強化」の3つに分かれていくという見方です。

Breunig氏はこの3つの作業を以下のように分類しました。まず「開発」では、何を作るかを人間が決めたり、利用者の反応を見たりしながら機能を素早く作ります。次の「レビュー」ではドキュメントを整えたり、リファクタリングを進めたりします。そして最後の「安全性の強化」では、予算が尽きるまで脆弱性を探してつぶしていきます。

「開発」では人間の判断や利用者の反応が作業を進める上での制約になり、「安全性の強化」では資金が作業の制約になるため、開発と安全性の強化は別々の工程になっていくとBreunig氏は述べています。

Breunig氏は「コードを書くこと自体は今後も引き続き安くなるだろう」と述べています。しかし、作ったコードを安全にしようとすると話は別で、AIモデルの性能が伸び続けるのであれば、守る側は攻撃側より多くのトークンを買って脆弱性探しに使い続ける必要があるとBreunig氏はみています。

このBreunig氏の主張に対してソーシャルニュースサイトのHackerNewsでは、「AISIの評価だけで『守るにはより多くのトークンが必要だ』と一般化するのは早く、形式手法のような別の防御策もあるのではないか」という慎重論や、「守る側はソースコード全体や変更差分を見ながら定期的にまとめてスキャンできるため、攻撃側より効率よく動ける場面も多く、むしろソフトウェアの安全性が高まる可能性もある」という補足が投稿されています。

なお、AISIは「テスト内容には『AIモデルがセキュリティアラートをトリガーする行動を取ってもペナルティがない』といった制約があったため、アクティブなセキュリティツールやセキュリティ担当者が存在する十分に防御されたシステムを攻撃できるかどうかは断言できない」と述べています。

この記事のタイトルとURLをコピーする