Avidは、Google Cloudとの複数年にわたる戦略的提携を発表した。これにより、GeminiモデルとVertex AIがMedia Composerおよび新たに商用化されたAvid Content Coreプラットフォームに直接組み込まれることになる。この統合により、自然言語によるメディア検索、メタデータの自動記録、スタイルマッチングやBロール生成といったタスクを自律的に処理できるエージェント型AIワークフローが実現する見込みで、最初の公開デモはNAB 2026で行われる予定だ。

この提携は、Avidの2つの主力製品を対象としている。Media Composerは、ハイエンドの映画・テレビポストプロダクションにおいて依然として支配的なNLEであり(Avidによれば、今年のアカデミー賞受賞作品の87%が同社のプラットフォームで制作されたという)、もう一つは、グローバルなメディア資産のための統合データレイヤーとして機能するクラウドネイティブのSaaSプラットフォーム「Avid Content Core」だ。なお、AvidはNABにおいてAWSとの並行した提携も発表しており、Content CoreとMedia ComposerをAmazonのクラウドインフラ上で稼働させる予定だ。したがって、同社は単一のプロバイダーに縛られるのではなく、マルチクラウド戦略を明確に追求している。

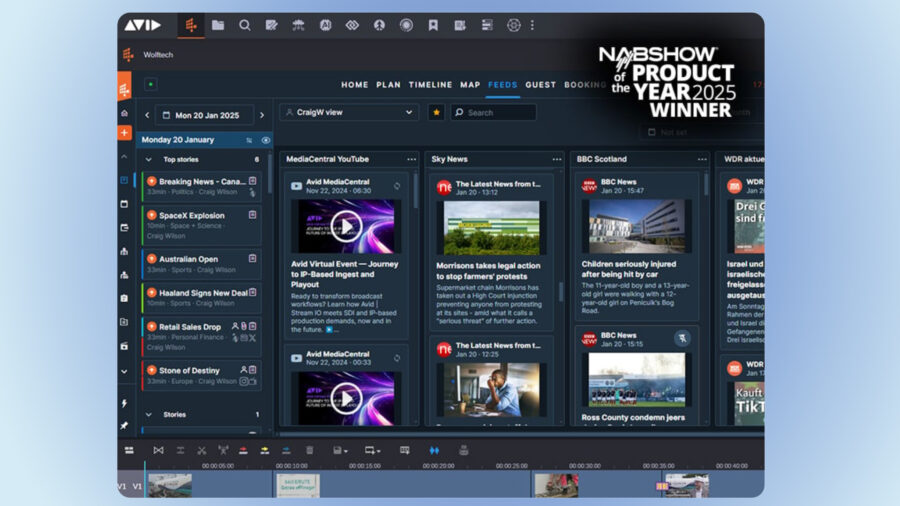

AIを活用したポストプロダクションワークフロー。画像提供:AvidGemini統合の実際の機能

AIを活用したポストプロダクションワークフロー。画像提供:AvidGemini統合の実際の機能

Media Composer内で、GoogleのGeminiモデルを搭載した新しいマルチモーダル拡張機能により、ポストプロダクションにおけるいくつかのボトルネックが解消される。両社によると、この統合機能はインテリジェントなメタデータ強化、自動ロギング、Bロールの生成をカバーしており、これらはすべて、手作業の負担を軽減するように設計されている。デイリーのロギングや、説明的なメタデータによる映像の手動タグ付けに何時間も費やした経験があるなら、まさにこれがAvidとGoogle Cloudが対象としている作業だ。

さらに野心的な要素は、エージェント型AIのコンポーネントだ。固定されたスクリプトに従う単純な自動化ではなく、エージェント型ワークフローは、複雑なタスクを自律的に管理できるデジタルアシスタントとして機能するように設計されている。AvidとGoogle Cloudは、クリップ間のビジュアルスタイルの整合や、未編集映像内の感情的な手がかりの特定といった機能を説明している。これらの機能が実際のプロフェッショナルな編集環境でどれほど機能するかはまだ未知数であり、NABでのデモで確認したい。

組み込みAIでコンテンツを管理。画像提供:Avid受動的なストレージから能動的なライブラリへ

組み込みAIでコンテンツを管理。画像提供:Avid受動的なストレージから能動的なライブラリへ

Avid Content Core側では、この統合によりGoogle CloudのBigQuery、Vision Warehouse、Vertex AI Searchを活用し、従来は受動的なストレージであったものを、はるかにインタラクティブなものへと変革する。その売り文句は、メディアライブラリの検索が自然な会話になるという点だ。ファイル名やタイムコードを使ってビンやフォルダ内を探し回る代わりに、ユーザーは視覚的なアクション、台詞の内容、あるいは感情のトーンに基づいて、必要なものを説明できるようになる。

AvidのCEOであるウェルフォード・ディラードは、この提携を顧客の要望への対応として位置づけ、制作チームが全く新しいパイプラインを必要とするのではなく、既存のワークフローに統合できるインテリジェントなツールを求めていると指摘した。Google Cloudの戦略的産業担当グローバルマネージングディレクターであるアニル・ジェインはさらに踏み込み、編集者がインテリジェントエージェントと協力して、タイムラインの充填やスタイルのマッチングといったタスクを処理できるようになったと示唆した。

分散したチーム間でテラバイト級の映像素材を管理する大規模な制作において、潜在的な時間短縮効果は極めて大きい。Avidは、このシステムにより、手作業でのアーカイブ検索に数週間かかっていた作業を、自動化された分析によって数秒で完了できると主張している。これは並外れた主張であり、展示会場でのデモを超えた実環境での検証が必要となるだろう。

編集ワークフローにおけるエージェント型AI。画像提供:AvidAvidの進化するAI戦略

編集ワークフローにおけるエージェント型AI。画像提供:AvidAvidの進化するAI戦略

このGoogle Cloudとの提携は、孤立したものではない。IBC 2025において、AvidはMedia Composer、Pro Tools、MediaCentral全体にわたるAI主導のアップデートを披露した。これには、組み込みの音声認識・テキスト変換機能、翻訳機能、SoundFlow統合およびPro Tools Scripting SDKを通じた自動化機能が含まれる。同社は、独立したAI製品を開発するのではなく、既存のツールにAI機能を着実に組み込んできた。

また、Avidのより広範な企業としての軌跡を思い出す価値もある。同社は2023年にプライベート・エクイティ企業のSTGに14億ドルで買収されたが、それ以来、クラウドネイティブインフラとAI統合への推進は明らかに加速している。その加速が真の製品ビジョンによるものか、それともプライベート・エクイティ傘下での成長を示す圧力によるものかは留意すべき点だが、両者は互いに排他的ではない。

映像編集におけるAIツール。画像提供:Avidユーザーにとってこれは何を意味するのか?

映像編集におけるAIツール。画像提供:Avidユーザーにとってこれは何を意味するのか?

今回の発表を巡る言及、特に能動的なAIという枠組みは、現役の編集者たちの間で、自らの仕事の長期的な方向性について疑問を抱かせるのも無理はない。映像のログ作成、メタデータのタグ付け、関連クリップの抽出を行うAIは、クリエイティブな判断に時間を費やしたいと考える大多数のプロフェッショナルから広く歓迎されている。しかし、Bロールを生成し、タイムラインを自律的に埋めるAIとなると、議論の分かれる領域に入り、支援と代替の境界線が曖昧になる。

公平を期すなら、AvidとGoogle Cloudはこれらの機能を、編集者がストーリーテリングやクリエイティブな意図に集中できるよう解放するツールとして位置付けている。この枠組みは、NLE分野における他のAI統合事例、例えば自動ラフカットへのEddie AIのアプローチや、Premiere ProにおけるAdobeのFirefly統合の拡大など、これまでに見てきたものと軌を一にする。問題は、AIがプロの編集ツールキットの一部になるかどうかではない。すでにそうなっているからだ。問題は、その過程でAIがどれほどのクリエイティブな裁量権を吸収してしまうかということだ。

AvidとGoogle Cloudは、ラスベガスで開催されるNAB Show(2026年4月18日~22日)で、これらの新しいワークフローを実演する予定だ。来場者は、Google Cloudブース(West Hall、W2731)およびAvidブース(North Hall、N2226)で、この技術の実際の動作を確認できる。

詳細については、Avidのウェブサイトをご覧ください。。