Meta Ray-Ban Display製品写真

Meta Ray-Ban Display製品写真

Metaがディスプレイ内蔵AIグラス「Meta Ray-Ban Display」を発表した。

Meta Connect基調講演会場に飾られたMeta Ray-Ban Display実機

Meta Connect基調講演会場に飾られたMeta Ray-Ban Display実機

すでに外観や、Meta Ray-Ban Display以外の新製品については記事を掲載している。

その後実機を体験できたので、その内容について詳報する。

体験会場にはすぐに長蛇の列がRay-Ban Metaにディスプレイを搭載

体験会場にはすぐに長蛇の列がRay-Ban Metaにディスプレイを搭載

MetaのAIグラスである「Ray-Ban Meta」は、スマホ上のアプリ「Meta AI」と連動して動く。音声でAIに質問し、音声で回答を得る。搭載しているカメラで「見た目・一人称視点」の写真や動画を撮影、シェアできる。

日本では販売されていないのでピンと来ないかもしれないが、アメリカを中心にヒットしており、スマホと連携する「次の存在」の本命になってきた。

Meta Ray-Ban Displayは、Ray-Ban Metaの兄弟モデルだ。違いは名前にあるように「ディスプレイ」があることだ。

Meta Ray Ban Display & Meta Neural Band

以下の写真は、基調講演でのデモで示されたものだ。

基調講演のデモより。カラーの見やすい表示で、予定や撮影した写真などが表示できる

基調講演のデモより。カラーの見やすい表示で、予定や撮影した写真などが表示できる

予定を表示し、相手の話すことを文字に書き起こし、撮影した写真や動画を画像で確認する。カメラのズーム機能もある。

これを実現しているのは、メガネのヒンジ部分に仕込まれた、小型のカラーLEDプロジェクターである。

その光をレンズ部に仕込んだ「ウェーブガイド」で目の中まで届ける。以下の写真中央に、青い線のようなものが見えるだろうか。これがウェーブガイドだ。

ヒンジ部に小型プロジェクターが組み込まれている

ヒンジ部に小型プロジェクターが組み込まれている 実機のレンズ部。よく見ると中央にウェーブガイドの存在が確認できる

実機のレンズ部。よく見ると中央にウェーブガイドの存在が確認できる

表示はかなり鮮明で、驚くほど解像感がしっかりしている。

Metaの資料によれば、プロジェクターは600×600ドットの正方形。それが視野に入ると、視度1度あたりに42ドットで構成される「42PPD」の解像感になる。600×600ドットはスマホなどと比べると小さな領域に過ぎないが、42PPDあると、実際の見た目にはドット感の薄い、緻密な映像に見える。

Metaの公式画像。右側に四角く映像が見える

Metaの公式画像。右側に四角く映像が見える

以下は、実際にかけてみた時の画像だ。撮影の関係で色がおかしくなっているが、その点はご了承いただきたい。実際にかけて目で見た時の色は、基調講演でのデモと同じく、ちゃんとした自然なRGBだ。

実際のデバイスで撮影した映像は、視野の中央に四角い領域があるように見える。実際この通りで、Meta QuestやApple Vision Proのように視野を覆うわけではない。スペックによれば、映像の視野は20度だという。

実機での写真。カメラでの撮影位置の関係から、発色は正しく表現されていない。しかし、このくらいしっかりした明るさで、視野の中にメニューなどが見える

実機での写真。カメラでの撮影位置の関係から、発色は正しく表現されていない。しかし、このくらいしっかりした明るさで、視野の中にメニューなどが見える

製品名が「Meta Ray-Ban Display」であり、「AR」や「MR」などの言葉がないのはこのためだ。

Meta Ray-Ban Displayはあくまで、スマホの上にある専用アプリが作り出した映像を「視界の特定の場所に表示するディスプレイを搭載した機器」である。

だから、いわゆるARやMRのような表現ではないし、「XREAL One」のような空間にディスプレイを配置するものでもない。情報やアプリを視界に表示する「情報ディスプレイを搭載したAIグラス」なのだ。

昨年のMeta Connectで発表された試作ARデバイス「Orion」と似たデバイスは使っているが、AR機器であるOrionとは似て非なる存在である。

「コントローラー」の存在が他との差別化点

この種の「情報表示型のスマートグラス」は他にもある。

Meta Ray-Ban Displayの違いは、スマホの通知などを「表示するだけ」ではなく、複数のアプリを画面内で動かすことにある。

以下は、スマホ上にMeta Ray-Ban Displayの表示している画面が表示されたものである。おそらくはデモ用と思われる。

デモ体験中のスマホ画面。実際にはスマホに映っているのと同じ映像が、同じようなクオリティでMeta Ray-Ban Displayの中に表示されている

デモ体験中のスマホ画面。実際にはスマホに映っているのと同じ映像が、同じようなクオリティでMeta Ray-Ban Displayの中に表示されている

左側は操作のチュートリアルを兼ねたゲームで、右側はメインメニューだ。

Meta Ray-Ban Displayには、視線操作や指先の位置を認識する機能はない。要は、マウスなどと同じような「ポインティングデバイス」が存在しないわけだ。

そこで出てくるのが「Meta Neural Band」だ。

Meta Neural Band。利き手にしっかりと締めて使う。ただし実際には、利き手以外でも操作はできるという

Meta Neural Band。利き手にしっかりと締めて使う。ただし実際には、利き手以外でも操作はできるという

Meta Neural Bandは、指先の細かな動きを腕の筋電位から読み取る。あくまで「指先の動き」であって「指の位置」ではない。

Meta Neural Bandの内側には筋電位センサーが

Meta Neural Bandの内側には筋電位センサーが

親指と人差し指を打ち合わせると「タップ」、親指と中指だと「キャンセル」や「バック」という動作になるが、もっと多彩な動きを読み取る。

例えば、親指を人差し指に沿って左右に滑らせる動作は「メニューの左右移動」になり、親指を上下に滑らせる動きは「メニューの上下移動」になる。

指先で「つまみを持って回す」ような動きをすると、音量などの「ボリューム調整」になる。カメラが捉えている映像を「ズーム」するときもこの動きになる。

スマホやPCのアプリを自由に操作するのとは違うが、ちょっとしたメニューの選択には十分な機能を持っている。

以下は、音楽プレイヤーを操作している時の筆者の指の動きだ。捻っている時にはボリュームを、それ以外の時はメニューを選んでいると思えばいい。

コントロールしているところ

そもそも、この操作は腕がどこにあっても使える。

手を膝や机の上に置いて操作してもいいし、ポケットの中に手を入れたまま操作してもいい。だから腕を空中にあげて操作する必要はなく、疲れを感じづらい。

操作中の筆者。結構腕を持ち上げているが、実際には完全に下ろしてしまっていてもいいAI連携で色々な用途に

操作中の筆者。結構腕を持ち上げているが、実際には完全に下ろしてしまっていてもいいAI連携で色々な用途に

そうやって操作する中でも特別な機能になるのが、「Meta AI」に絡む機能だ。

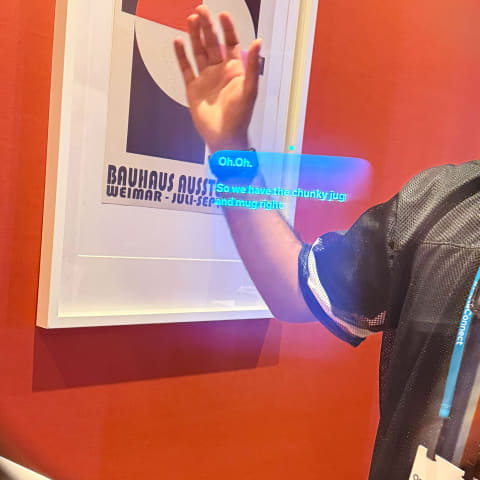

体験できたデモの中には、目の前にあるイラストやオブジェについてMeta AIに聞く……というものがあった。

これらの場合にはMeta Ray-Ban Displayのカメラが自動的に写真を撮り、マルチモーダルAIによって画像を解析し、音声とテキストで答えを返してくる。

Meta AIにイラストの詳細を尋ねるデモ。中央に答えが表示されている

Meta AIにイラストの詳細を尋ねるデモ。中央に答えが表示されている

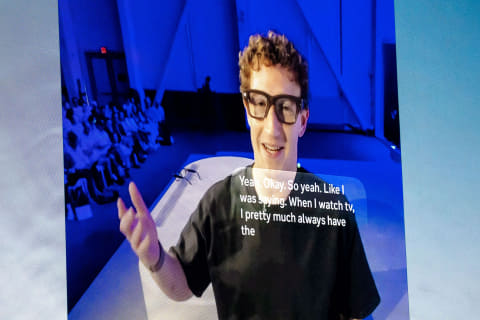

また、相手の話す声を書き起こす「ライブトランスクリプト」のデモでは、目の前の相手の声だけを把握し、文章としてほぼリアルタイムで表示していた。そこにAIの翻訳機能を噛ませれば「リアルタイム翻訳」になる。どんな風に見えるかは、以下のビデオをご覧いただきたい。

ライブトランスクリプトのデモ中

ライブトランスクリプトのデモ中

ライブトランスクリプト

この他にも、Spotifyを再生する音楽プレーヤー機能や、撮影した写真や動画を見る機能もあった。デモで体験することはできなかったが、スマホなどとビデオ通話をやりとりすることもできる。

現状では「いくつかの有用な機能が組み込まれている」状況で、Meta Neural Bandの操作でそれらの機能を呼び出す……という形であるように思えた。独自のアプリを作って利用できるかどうかは、現時点では確認できていない。

製品として最も似ているのは、5月にGoogleが発表した「Android XR搭載デバイス」のうち、スマートグラス型のものがそれに当たる。おそらく狙いも機能も近い。

だが、Meta Neural Bandがあって色々な操作がしやすい……というのが差別化点だろうか。

そして、この種のデバイスとしては「最初の製品から価格が抑えられている」点も大きい。

カラーの精細なディスプレイを搭載し、コントローラーがついて800ドル(約11万8000円)というのは、お手軽……というには高いが、体験としてはかなり安い。

Metaは相当の開発期間をかけて、「普及前段階から、かなり低価格にAIグラスを開発して販売する」という形を実現したのだ。