AIが生成した画像を見分けることは、日に日に難しくなっています。もちろん、これまでは特有の「識別ポイント」がありました。しかし、新しいAI画像モデルが登場するたびに、そうした違和感は最小限に抑えられつつあります。

【全画像をみる】OpenAI「Images 2.0」はテキスト描写を大幅改善!ついにAI生成画像の見分けが困難に

たとえば、かつては「AIが描く人間の手は指の数が多すぎたり少なすぎたりする」と言われてきましたが、今や必ずしもそうとは限りません。

【この記事の3行ポイント】

OpenAIがChatGPT向けに発表した最新モデル「Images 2.0」は、AI画像特有の違和感を大幅に軽減。

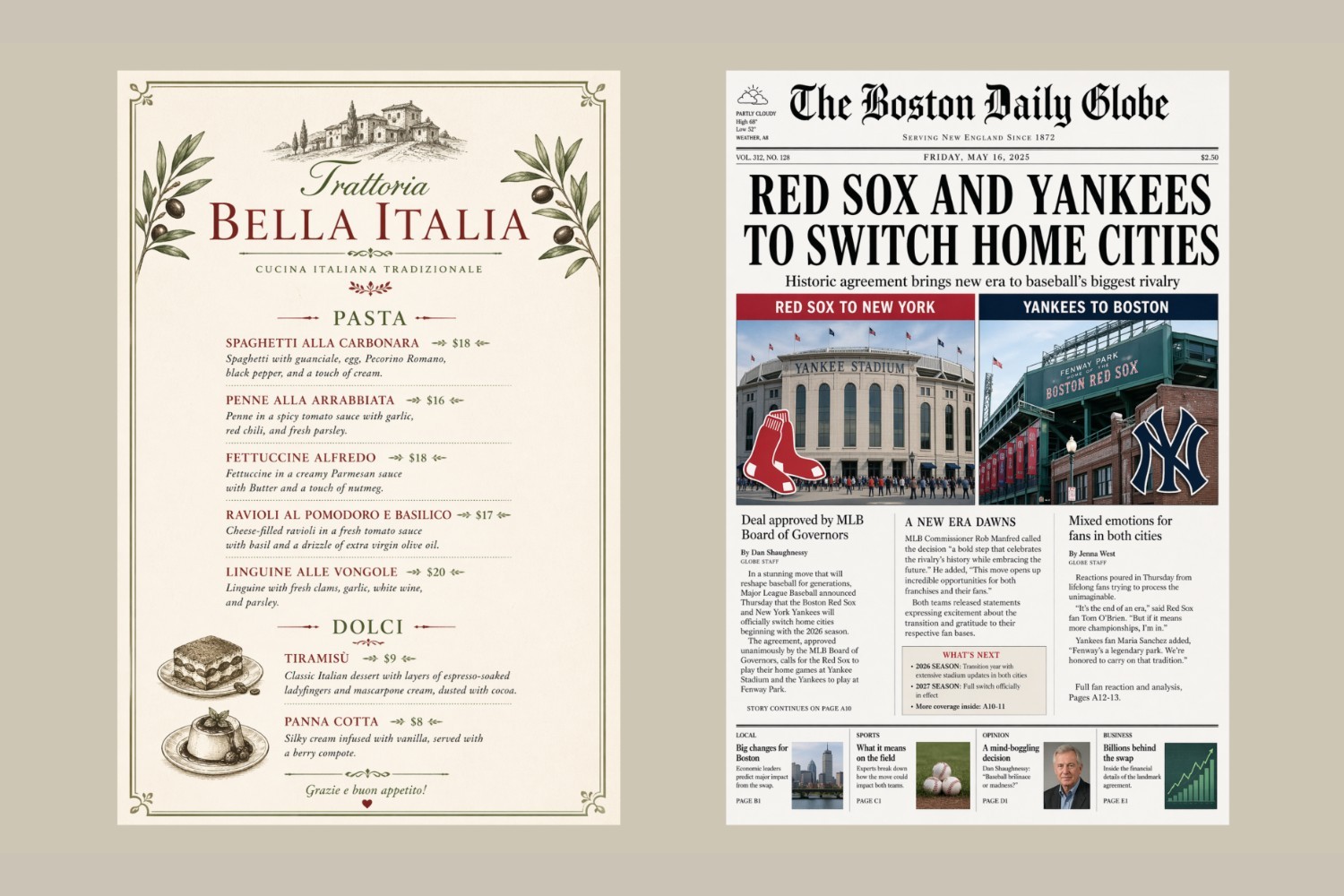

これまでAIが苦手としてきた「画像内のテキスト生成」が劇的に進化し、メニュー表や新聞記事も正確に描写可能。

「思考」プロセスを導入したことで、複雑なリクエストの理解やパノラマ画像、手書きの質感といった高度な表現ができる。

AIが克服した「文字」という最大の弱点

これまで、AI画像モデルにとって特に弱点となっていた領域が「テキストの生成」でした。

画像そのものは説得力があるように見えても、そこに描かれた文字をよく見てみると、正しくないことが多いのです。一部の単語は正確であっても、ほかは惜しいところで間違っていたり、多くの場合、支離滅裂な箇所が目につきました。

文字が過剰に繰り返されていたり、そもそも文字ですらない記号だったり、文字同士が混ざり合って歪んでいたりしたのです。こうした奇妙なクセは、AIがアメリカ英語を再現しようとする際、「スター・ウォーズ」に登場する架空の言語のように見えていました。

しかし、最新のAIモデルはテキスト生成能力が飛躍的に向上。実際のところ、ChatGPT向けの最新モデルである「Images 2.0(イメージ 2.0)」は、極めてリアルなテキストを、しかも大量に描写することが可能です。もはや、私たちの多くが、それを見分けることができるのか確信が持てないレベルにまで達しています。

OpenAIによれば、Images 2.0は同社初の「思考能力を備えた画像モデル」だといいます。

これは、モデルがリクエストの各ステップを時間をかけて分解・検討できることを意味しており、結果としてより詳細で正確な画像を生成できるようになったほか、1つのプロンプトから最大8枚の画像を生成することもできます(※最大8枚の生成は有料プランのユーザーのみ利用可能)。

無料ユーザーも、情報を得るためのウェブ検索や、生成内容のダブルチェックといったImages 2.0の恩恵を享受できます。

同社は「生成結果はAIが作ったというよりも、意図的にデザインされたように感じられる」と述べていますが、要するに、今後ChatGPTで生成された画像を見分けることが非常に困難になるということを示唆しています。