Metaは米国時間2026年4月8日(現地時間)、新しい大規模言語モデル「Muse Spark」と、それを用いたMeta AIのアップグレードを発表した。Muse Sparkは、Meta Superintelligence Labsが開発する「Muse」シリーズの初弾であり、画像を含む入力を前提に推論できるネイティブなマルチモーダルモデルと位置付けられている。Metaによれば、ツール利用、視覚情報を踏まえた推論、複数エージェントの並列実行に対応する。

提供先は、まずmeta.aiとMeta AIアプリだ。あわせて、基盤技術の外部提供については限定的なAPIプレビューも始める。一般公開時の料金や商用条件は現時点で明らかにしていない。利用体験の面では、素早く返答する「Instant」と、より深い推論を使う「Thinking」を切り替えられる構成を導入する方針も示した。

// 目次

Meta AIの先行基盤としてMuse系を前面に出した

InstantとThinking、並列エージェントで操作体験を組み替える

画像理解、健康支援、ビジュアルコーディングを重点用途に据える

9カ月で学習スタックを再構築し、効率改善と推論強化を打ち出す

安全性評価を先行させ、拡大展開とリスク管理を並行させる

今回の発表の軸は、新モデルの追加そのものより、Meta AIの新しい基盤としてMuse Sparkを前面に押し出した点にある。MetaはMuse Sparkを「小型で高速」に設計した初代モデルと説明しつつ、科学、数学、健康分野の複雑な質問にも対応できる基盤だと位置付けた。現時点でMeta AIアプリとmeta.aiを支えるモデルとして投入されており、次世代モデルの開発も並行して進めている。

技術ブログでは、Muse Sparkを「個人向けスーパーインテリジェンス」へ向かう最初の段階と表現している。そこで目指しているのは、テキストだけを処理するチャットボットではなく、ユーザーが見ている物や置かれている状況を踏まえて応答するAIアシスタントだ。製品発表側でも、Meta AIを「説明を受けて理解するAI」より、視覚情報を取り込みながら状況を把握するAIとして描いている。

項目公式発表で示された内容モデル名Muse Spark系列Museシリーズの初弾開発主体Meta Superintelligence Labs基本特性ネイティブなマルチモーダル推論モデル主な対応ツール利用、視覚情報を踏まえた推論、複数エージェントの並列実行現時点の提供先meta.ai、Meta AIアプリAPI提供限定的なプライベートプレビュー開発の次段階より大きな次世代モデルを開発中

ここから分かるのは、Muse Sparkが研究用デモではなく、Meta AIの実サービスで先に展開されるモデルだという点だ。まず自社接点で使い始め、外部向けAPIは限定公開にとどめる構えで、一般開発者向けに一斉公開する段階ではない。

InstantとThinking、並列エージェントで操作体験を組み替える

製品面の変更では、Meta AIの応答モードを分ける設計が目立つ。Meta AIアプリとmeta.aiでは、新しい見た目とともに、短時間で返す用途と、より強い推論が必要な用途を分けて扱う構成を導入する。Metaは、日常的な質問から複雑な課題まで1つのサービス内で扱う狙いを示している。

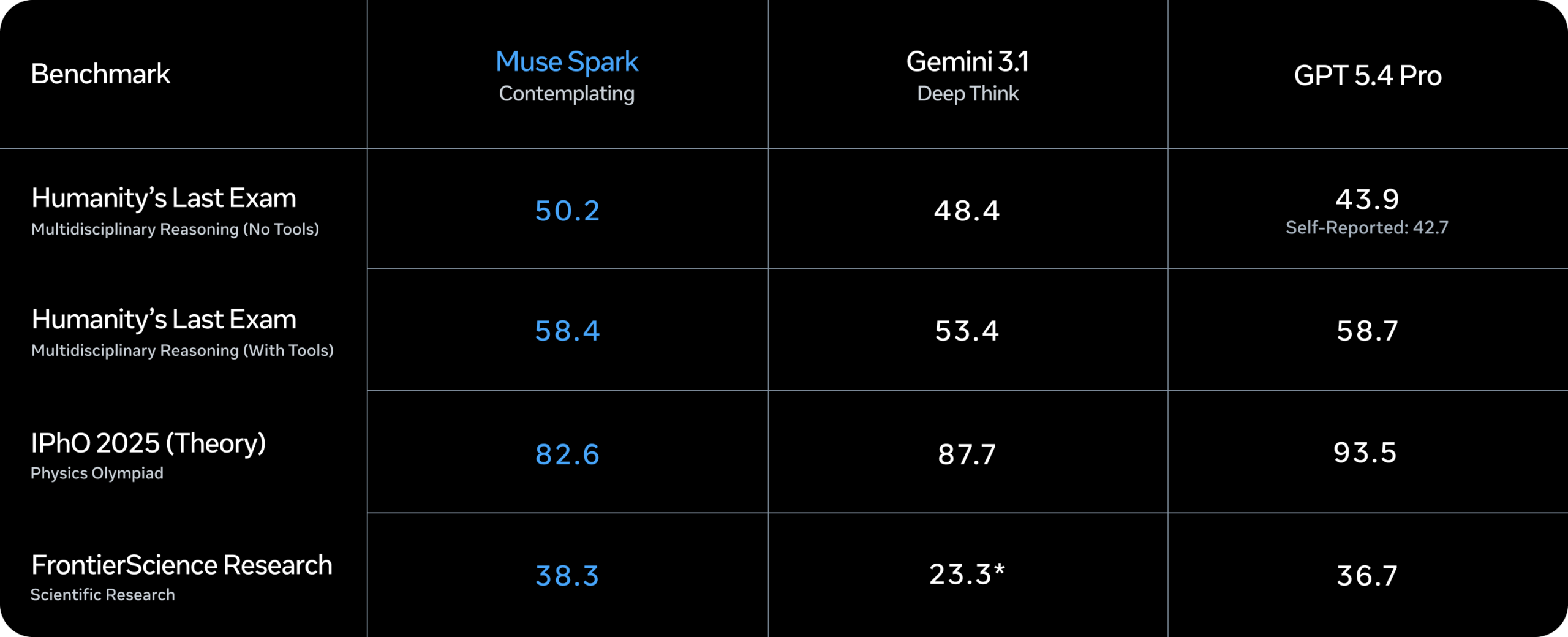

製品発表では、家族旅行の計画を例に、あるエージェントが旅程を組み、別のエージェントが候補地を比べ、さらに別のエージェントが子ども向けの行き先を探す流れを示した。技術ブログでは、この仕組みに対応するものとして「Contemplating mode」を紹介している。難しい問題で複数のエージェントを同時に走らせ、単一エージェントが長時間考える方式に比べて、近い応答速度でより高い性能を狙う設計だという。

展開先・機能発表時点の案内Meta AIアプリアップグレード版を提供、Instant/Thinking対応meta.aiアップグレード版を提供、Contemplating modeは段階的に展開新機能の初期展開まず米国で順次展開今後数週間の拡大先その他の国、Instagram、Facebook、Messenger、WhatsAppAI glasses今後対応予定、視覚理解機能を生かす想定API限定的なプライベートプレビュー

ここでは、提供開始の段階差が重要になる。Meta AIアプリとmeta.aiは先行して更新される一方、Contemplating modeはmeta.aiで順次展開とされている。さらに、InstagramやWhatsAppなど他のMeta製品群への拡大は数週間単位の後続計画であり、発表時点で一斉にそろうわけではない。

画像理解、健康支援、ビジュアルコーディングを重点用途に据える

Muse Sparkの用途としてMetaが繰り返し挙げているのは、マルチモーダル理解、健康分野、ビジュアルコーディングである。モデルは視覚情報を前提に設計されており、視覚系STEM問題、物体認識、位置特定で強い性能を持つと説明されている。家電を見ながら注釈付きでトラブルシュートしたり、周囲の状況を踏まえて応答したりする用途が例示されている。

健康分野では、1,000人超の医師と協力して学習データを整備したと明らかにした。食品の栄養情報を分解表示したり、運動中にどの筋肉が使われているかを示したりと、画像や図を扱う説明を重視している。Metaは、健康関連の相談がAI利用の主要な動機の一つだとみており、この領域を実用性の高い用途として扱っている。

加えて、Muse SparkはプロンプトからミニゲームやWebサイトを作る「visual coding」にも対応する。製品発表では、パーティー計画用ダッシュボード、レトロゲーム、フライトシミュレーターのような例が挙がっている。文章応答にとどまらず、視覚的な成果物をその場で組み立てる用途まで視野に入れていることが分かる。ショッピング支援や検索でも、Metaの各アプリで流通している投稿やコミュニティ情報を、会話の近くで参照する方向が示された。

9カ月で学習スタックを再構築し、効率改善と推論強化を打ち出す

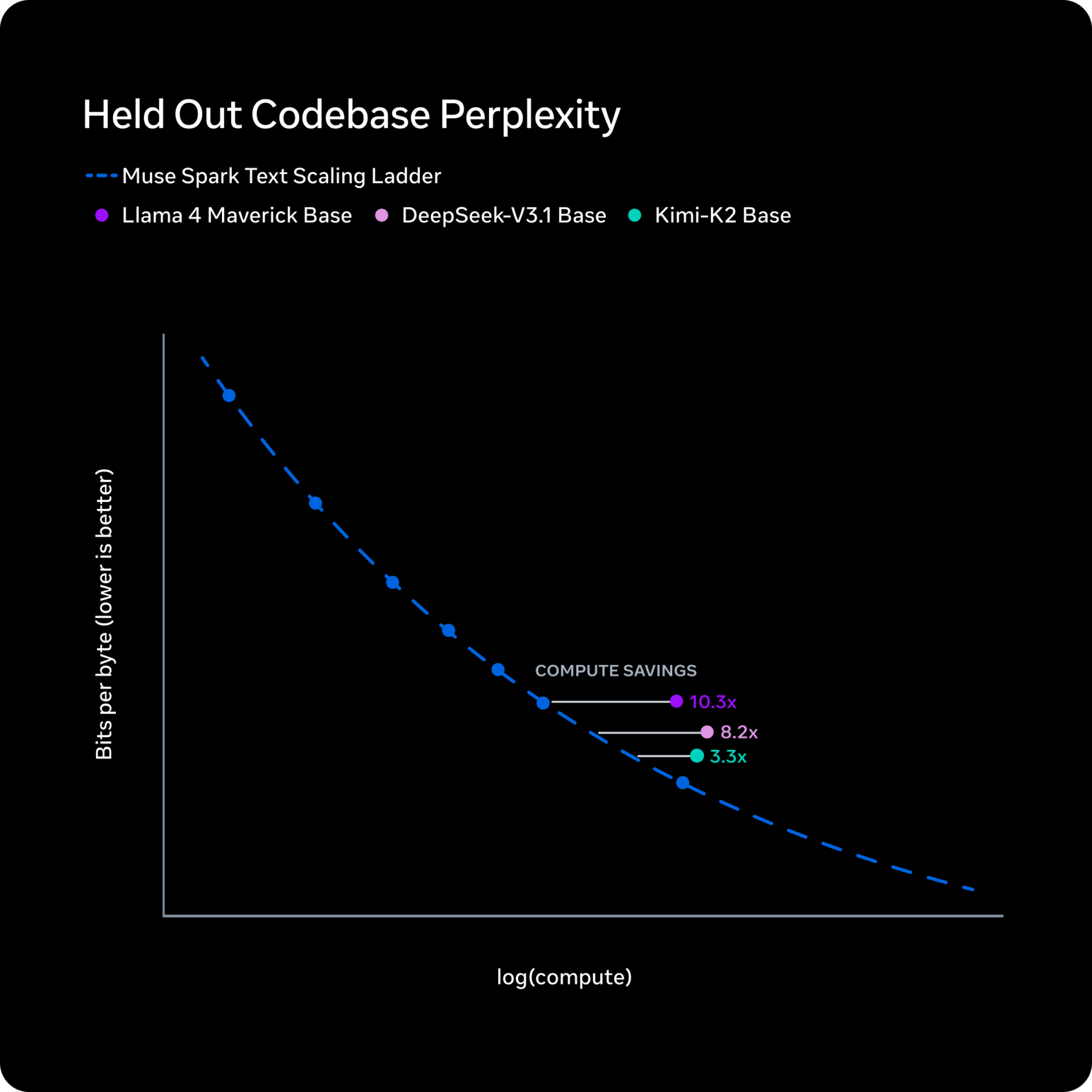

技術発表の中心は、Metaが過去9カ月で事前学習スタックを作り直したという説明だ。アーキテクチャ、最適化、データキュレーションを見直した結果、従来モデルのLlama 4 Maverickと同等の能力水準に届くための計算量を、1桁以上減らせたとしている。正確な倍率までは示していないが、計算効率の改善を新スタックの成果として強く訴えている。

そのうえで、事後学習には強化学習を使い、テスト時には「考える長さ」にペナルティをかけて推論トークンを抑える「思考圧縮」も紹介した。高難度タスクへの対応では、1つのモデルに長く考えさせるより、複数エージェントを並列に動かす設計へ重心を移している。

指標・仕組み公式発表の内容事前学習効率Llama 4 Maverickと同等能力に1桁以上少ない計算資源強化学習大規模RLでも滑らかで予測可能な性能向上を得たと説明テスト時推論thinking time penaltyでトークン効率を最適化並列推論複数エージェントで高難度課題に対応Contemplating mode評価Humanity’s Last Examで58%、FrontierScience Researchで38%

この比較から見えるのは、Muse Sparkが高速性だけを売りにしたモデルではないということだ。Metaは、計算効率を上げつつ、必要な場面では重い推論も提供できる構成を商品化しようとしている。Sparkはその成否を示す初期モデルであり、Metaが今後出すとするより大きなMuse系モデルの土台でもある。

安全性評価を先行させ、拡大展開とリスク管理を並行させる

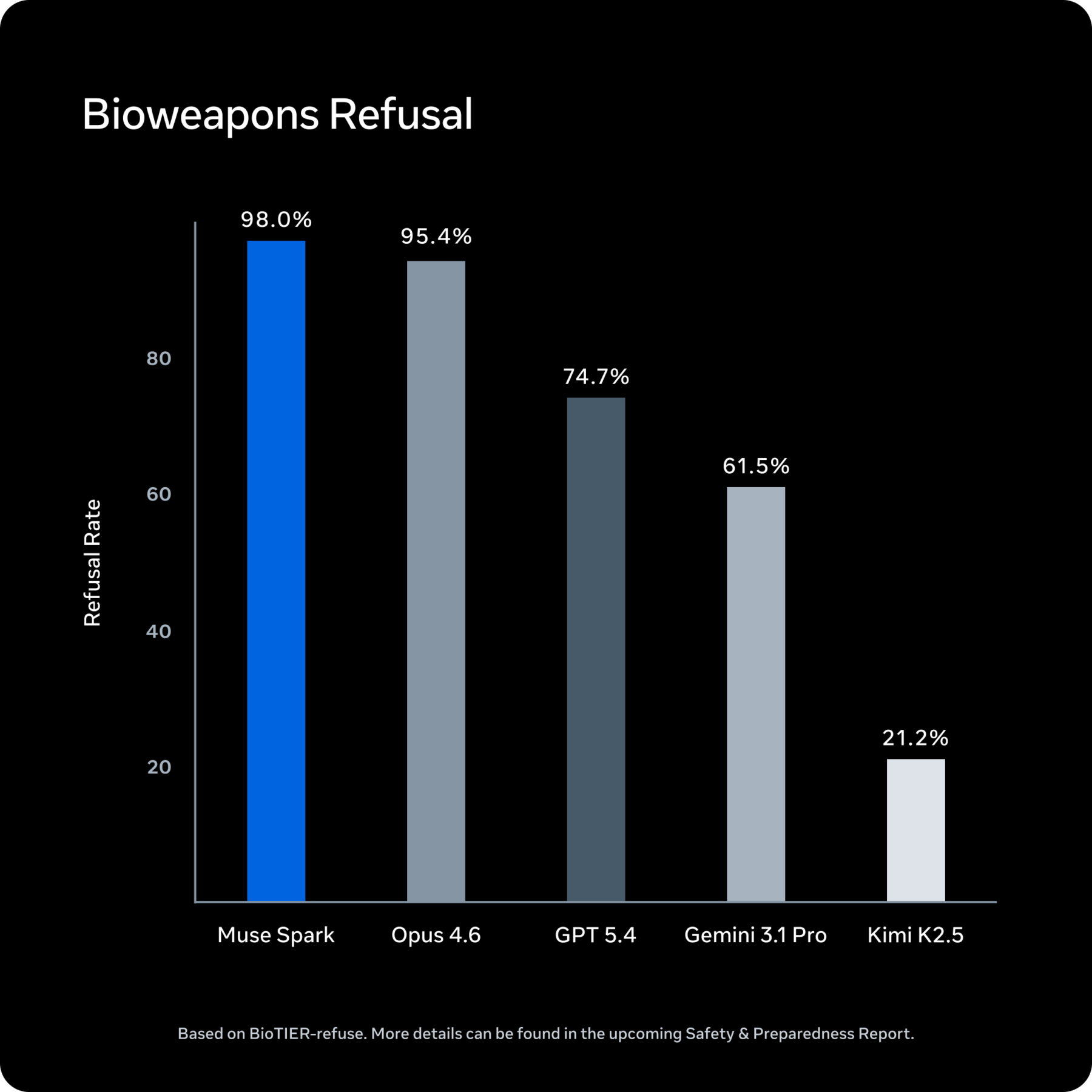

MetaはMuse Sparkについて、更新版のAdvanced AI Scaling Frameworkに沿って事前・事後の安全性評価を行ったと説明した。対象には、生物・化学兵器、サイバーセキュリティ、Loss of Controlといった高リスク領域が含まれる。Metaの説明では、今回の配備条件に照らす限り、安全域に収まるという判断である。高リスク領域での拒否挙動は、事前学習時のデータフィルタリング、安全性重視の事後学習、システムレベルのガードレールで支えているという。

また、Apollo Researchによる立ち上げ直前チェックポイントの外部評価では、Muse Sparkが評価環境を認識する割合が高かったとされる。Metaは、この点を公開差し止めの判断材料にはしていない一方で、今後公開予定のSafety & Preparedness Reportで詳細を示すとしている。性能向上を急ぎながら、評価枠組みの説明も同時に前へ出している点は、より大きな後継モデルでも継続して見られる論点になりそうだ。

今回の発表は、新モデル1本の投入というより、Meta AIを自社の主要サービス群へ広げていくための基盤づくりとして読むほうが実態に近い。Meta AIアプリとmeta.aiを先行させ、そこからInstagram、Facebook、Messenger、WhatsApp、AI glassesへ広げる構図が明示されたためだ。今後の焦点は、この展開計画が実際にどの順番と範囲で進むか、限定APIがどこまで拡大するか、そしてSparkで示した学習・推論の設計が次世代Museでどこまで伸びるかに移る。

Sources