Metaは8日、同社のAIへの取り組みについて報道関係者向けの説明会を開催した。AIを専門とする研究部門「Fundamental AI Research(FAIR)」と大規模言語モデル(LLM)「Llama」を中心に、MetaによるAI開発のこれまでと今後について説明した。Llamaについては先日、Llama 3.2を公開しているが、次世代のLlamaの展開についても言及された。

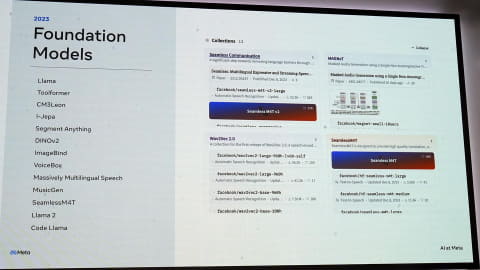

Metaは、2013年にFAIRを立ち上げ。2016年には機械学習のフレームワークである「PyTorch」をリリース、2023年にはオープンなLLM「Llama」を立ち上げるなど、10年以上に及ぶAI開発の歴史を有している。その特徴は「オープンであること」と強調しており、Llamaなど1,000以上のプロジェクトを公開している。こうしたオープンな取り組みにより、コミュニティやエコシステムを構築。「社会にAIが価値をもたらせることを示す」という。

ARグラスで自動翻訳を実現する「Seamless」

ARグラスで自動翻訳を実現する「Seamless」

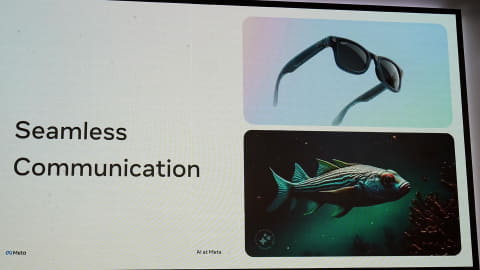

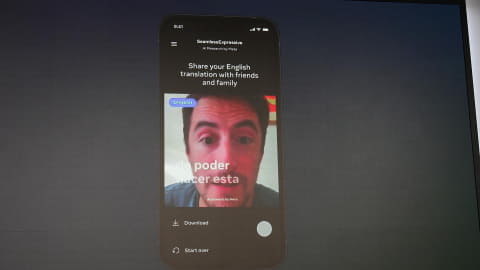

音声関係のプロジェクトでは、音声入力とプロンプトによる音声生成を組み合わせて利用できる「Audio box」のほか、今後のAI活用の方向性として「Seamless Communication」を紹介した。

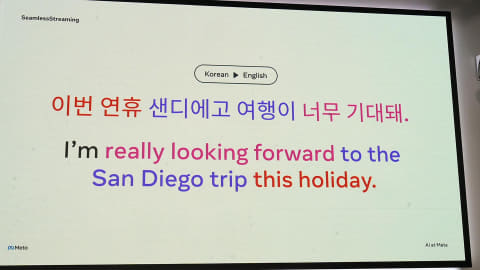

Seamlessは、リアルタイムで多言語翻訳できる機能となり、将来的にはMetaのARグラス「Ray-Ban Metaスマートグラス」などへの搭載を見込む。

すでに100以上の言語の翻訳に対応し、多くの言語を「同時通訳者相当」の速度で翻訳でき、万能翻訳を可能にする架空の魚「バベルフィッシュ」をイメージしている。

Seamless

Seamless

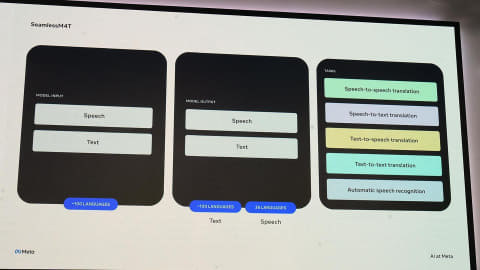

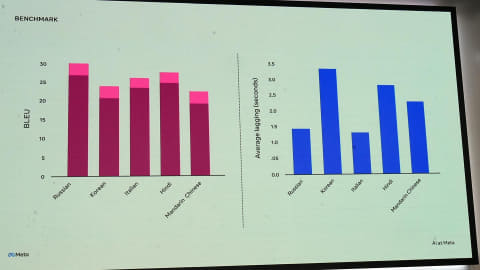

基盤となるのは、多言語翻訳モデルの「SeeamlessM4T」。実際に、日本語や英語、ドイツ語、ロシア語など様々な言語に対応している。ただし、英語への翻訳では、ロシア語やイタリア語は遅延(レイテンシ)が少ないものの、日本語や韓国語はレイテンシが多くなるという。

SeeamlessM4T

SeeamlessM4T

これは言語による語順の違いで、日本語や韓国語では文章の後半まで聞かないと、文意を取れないため。ただし、翻訳品質においては言語間で顕著な差は無いとのこと。

語順の違いがレイテンシに影響する

語順の違いがレイテンシに影響する イタリア語やロシア語はレイテンシが短い

イタリア語やロシア語はレイテンシが短い Seamless

Seamless

会場では、Meta Questを被り、Seamlessの翻訳言語を字幕と音声で紹介するデモも実施。現時点では、クラウド経由での翻訳を行なっているが、今後はオンデバイスでの翻訳の実現を目指す。