Claude APIに、エージェントが判断に詰まった瞬間だけ上位モデルへ相談できる仕組みが加わった。2026年4月9日にベータ公開された「アドバイザーツール(advisor_20260301)」は、HaikuやSonnetを主役のExecutor(実行役)に据え、Claude Opusを黒子のAdvisor(相談役)として組み合わせる設計だ。Opusはツール呼び出しもユーザー向け出力も一切行わず、Executorから問われたときのみ判断を返す。Anthropic内部の評価では、この構成でSonnet単独よりコストを11.9%削減しながら精度を2.7ポイント向上させた。「安いモデルは精度が低い」という前提を覆す実用的なアプローチが、エージェント開発の費用対効果に新しい選択肢を提示している。

// 目次

エグゼキューターが主役、アドバイザーは黒子——従来設計の逆転

ベンチマークが示す数値:コスト11.9%削減と精度向上の同時達成

1行の変更で動く:advisor_20260301ツールの実装

先行する学術研究:GPT-5とGemini 3 Proで示された汎用性

現在の制限とアクセス方法

エグゼキューターが主役、アドバイザーは黒子——従来設計の逆転

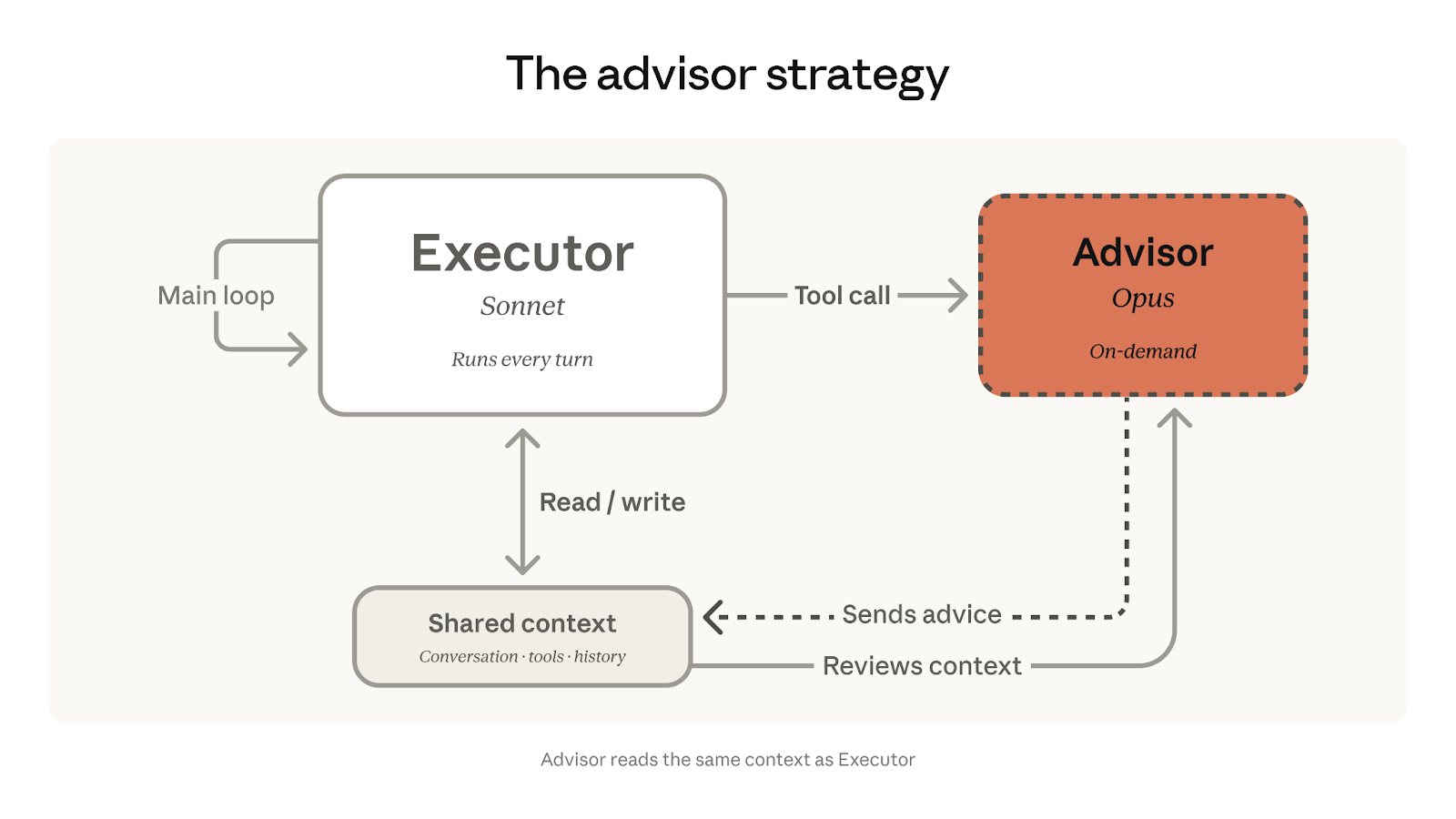

通常、AIエージェントの設計では「難しいタスクには大型モデルを使う」という発想が基本となる。判断が難しければOpusで、単純なら軽量モデルで、という切り替えロジックを開発者が手動で実装するか、あるいはすべてのタスクをOpusに任せてコストを受け入れるか——この二択が長く続いていた。

主役はあくまでSonnetまたはHaikuだ。これらがエグゼキューターとして推論・ツール呼び出し・ユーザーへの返答をすべて担う。OpusはExecutorが「判断に詰まった」と判断した瞬間だけ呼び出され、アドバイスを返したら処理から退く。

(Credit: Anthropic)

Opusへの相談は1回あたり400〜700テキストトークン程度で完結する。大半のタスクではOpusが一度も呼ばれず、コストはHaikuやSonnetの処理分だけで済む。重いタスクでも、Opusが介入するのは意思決定の核心部分のみだ。Opusはユーザーのリクエストもツールのレスポンスも直接受け取らず、Executorが「この判断をどう下すべきか」という問いだけを受け取る。このアーキテクチャにより、課金もAdvisorとExecutorで別々に発生し、コスト構造が透明になる。

ベンチマークが示す数値:コスト11.9%削減と精度向上の同時達成

Anthropicが公開したベンチマーク結果は、コストと精度のトレードオフが一定の条件下で成立しないことを示している。

SWE-bench Multilingualでの評価では、Sonnet+Opusアドバイザー構成がSonnet単独(adaptive thinking使用)と比べて精度を2.7ポイント向上、コストを11.9%削減した。ただし、評価条件は完全に同一ではない。Sonnet単独はadaptive thinking有効、アドバイザーあり版はthinking offかつ別システムプロンプトを使用している。Anthropicの内部評価として数値を読む必要はある。

BrowseComp(Webブラウジング能力の評価タスク)ではさらに際立った数値が出た。Haiku+Opusアドバイザー構成のスコアは41.2%で、Haiku単独(19.7%)の2倍超を記録した。Sonnet単独と比べるとスコアは29%低いものの、コストは85%安い。「Sonnetに近い精度を出したいがコストは抑えたい」という用途に対し、実用的な選択肢として機能する数値だ。

Bolt CEO兼創業者のEric Simmons氏は「複雑なタスクでよりよいアーキテクチャ上の意思決定を行い、シンプルなタスクでは余分なオーバーヘッドをゼロにする。プランや実行の軌跡がまったく別次元になった」と評価する。GensparkのCTO Kay Zhuも「エージェントのターン数・ツール呼び出し・総合スコアで明確な改善が見られた。自社で構築したプランニングツールより優れている」と述べている。

1行の変更で動く:advisor_20260301ツールの実装

アドバイザーツールの導入で既存コードへの変更は最小限だ。tools配列に以下のエントリを追加するだけで有効になる。

tools = [

{

“type”: “advisor_20260301”,

“max_uses”: 3 # オプション:1エージェントターンあたりの最大相談回数

}

]

max_usesパラメータでOpusへの相談回数に上限を設けられる。コスト予測を立てたい用途では重要なパラメータだ。省略した場合はExecutorが必要と判断した回数だけ相談が発生する。

利用にはリクエストヘッダーへの追加が必要だ。

anthropic-beta: advisor-tool-2026-03-01

現時点ではAnthropicのアカウントチームへの連絡によるアクセス許可が必要だ。ヘッダーを設定するだけで即日利用できるわけではなく、段階的なベータ展開として位置づけられている。

Eve LegalのMLエンジニアAnuraj Pandeyは実際の用途を「構造化ドキュメント抽出タスクで、Haiku 4.5が複雑度に応じてOpus 4.6に問い合わせ、フロンティアモデルと同等の品質を5分の1のコストで実現している」と説明する。Haiku単体では難しかった複雑度の高い文書処理が、Opusへの動的な相談によって精度を維持しながら動く構成だ。

先行する学術研究:GPT-5とGemini 3 Proで示された汎用性

arXiv論文「How to Train Your Advisor: Steering Black-Box LLMs with Advisor Models」(Asawa et al., arXiv:2510.02453)は2025年10月2日に公開されており、Anthropicの実装発表より半年早い。著者はParth Asawa、Alan Zhu、Abby O’Neill、Matei Zaharia、Alexandros G. Dimakis、Joseph E. Gonzalesで、Anthropicとは独立した研究だ。

この研究ではQwen 2.5 7BなどのオープンウェイトLLMをアドバイザーとして学習させ、GPT-5のRuleArenaテストで正解率を31.2%から53.6%(71%向上)させた。Gemini 3 ProのSWEエージェントタスクではステップ数を31.7から26.3へと24.6%削減している。

Claude、GPT-5、Gemini 3 Proという異なる基盤モデルで同様の効果が確認されていることは、「困ったときだけアドバイザーに相談する」アーキテクチャの汎用性を示している。Anthropicのモデルに特化した最適化ではなく、LLM全般に適用可能な設計パターンとして機能するという意味だ。論文の知見とAnthropicのAPIレベルの実装が重なることで、エージェント開発のデファクトパターンとして定着する可能性がある。

現在の制限とアクセス方法

アクセスの要件は2点だ。

リクエストヘッダー:anthropic-beta: advisor-tool-2026-03-01

事前条件:Anthropicアカウントチームへのアクセス申請

アドバイザーの処理はストリーミングに対応していない。Executorがアドバイザーに問い合わせている間、レスポンスのストリームは一時停止する。リアルタイム性を重視するUXでは設計上の考慮が必要になる点だ。ZDR(Zero Data Retention:データ保持ゼロ)には対応しており、エンタープライズ用途のデータ管理要件は満たされている。

コスト計算の透明性については、AdvisorとExecutorが別々に課金される構造が開発者に明確な予測可能性を与える。1回の相談が400〜700トークン程度であれば、max_usesを活用した上限設定で月次のAPI費用を管理しやすくなる。

アドバイザー戦略が示す設計思想は、単一モデルの性能向上とは異なるアプローチだ。学術研究がオープンウェイトモデルで同様の効果を示している以上、この構造はAnthropicの独自実装を超えて業界標準として普及する可能性がある。バッチ処理・構造化ドキュメント抽出・複雑な意思決定を含むエージェントを運用している開発者にとっては、ストリーミング制限とアクセス申請の手間を踏まえてもなお、今の段階で試す理由は十分にある。

Sources