2026年04月07日 16時14分

AI

高性能なAIモデルの入出力を抽出してほかのモデルの性能を向上させる手法を「蒸留」といいます。OpenAIやGoogleやAnthropicといったAI企業は自社製品を蒸留に利用することを規約で禁止しているのですが、中国企業による敵対的な蒸留が相次いでおり、3社は情報交換しながら対策に取り組んでいます。

OpenAI, Anthropic, Google Unite to Combat Model Copying in China – Bloomberg

https://www.bloomberg.com/news/articles/2026-04-06/openai-anthropic-google-unite-to-combat-model-copying-in-china

蒸留には「大規模なモデルの能力を抽出して、小規模かつ高性能なモデルを作る」という用途で使用される技術で、自社製品同士の蒸留や規約で蒸留が禁止されていないモデルからの蒸留は問題になりません。一方で、AI開発企業の多くは自社製品を蒸留目的で使用することを利用規約で禁止しており、APIを通じて蒸留を行っているとアカウント停止などの対象となることもあります。

APIにアクセスして使用目的を隠しながら蒸留を行う行為は「敵対的蒸留」と呼ばれており、中国の大手AI開発企業がアメリカのAI企業に対する敵対的蒸留攻撃を行っていることが指摘されています。例えば、中国企業のDeepSeekが2025年1月に発表した推論モデル「DeepSeek R1」は当時としては軽量かつ高性能であることがから大きな注目を集めましたが、発表の数日後にはOpenAIが「DeepSeek R1がOpenAIのモデルを蒸留して開発されたという証拠をつかんだ」という声明を発表しました。

DeepSeekがOpenAIのデータを「蒸留」してAIを開発していた可能性が浮上、OpenAIは「証拠がある」と発言 – GIGAZINE

1年後の2026年2月にはOpenAIがアメリカの下院中国問題特別委員会に対して「DeepSeekは、OpenAIや他のアメリカの先端研究機関が開発した能力にただ乗りする取り組みを継続している」と記した覚書を送付したことも報じられています。

OpenAIが「DeepSeekは蒸留で次世代AIを訓練しアメリカの主要AIに『ただ乗り』している」と議員へのメモの中で非難 – GIGAZINE

Googleの脅威インテリジェンスグループ(GTIG)も2026年2月13日に「Google製AIに対する敵対的蒸留攻撃が増加している」と報告。

Googleが「Geminiの能力を抽出して競合AIを開発しようとする蒸留攻撃が増加している」と報告 – GIGAZINE

さらに、Anthropicも2026年2月23日に「中国に拠点を置くAI企業のDeepSeek、Moonshot、MiniMaxが自社のモデルを改良するためにClaudeの能力を不正に抽出する大規模なキャンペーンを展開している」と主張しました。

Anthropicが「中国AI企業のDeepSeek・Moonshot・MiniMaxは不正にClaudeの能力を抽出している」と非難 – GIGAZINE

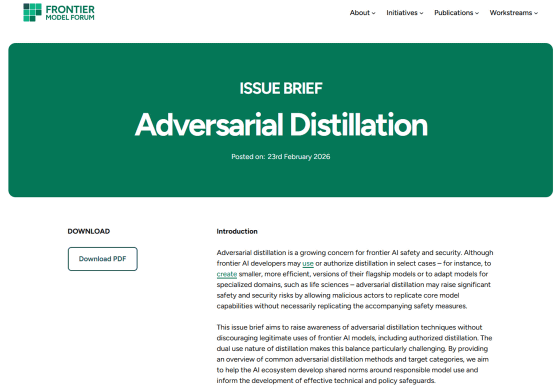

Bloombergの報道によると、OpenAIとGoogleとAnthropicは中国による敵対的蒸留攻撃に対抗するために企業の垣根を越えた協力体制を構築しているとのこと。具体的には、AI業界団体のFrontier Model Forumを通じて情報を共有し、敵対的蒸留攻撃の検出を強化しているそうです。

実際に、Frontier Model Forumは2026年2月23日に敵対的蒸留攻撃の問題点を解説する記事を公開しています。解説記事によると、攻撃者は多様な手法で蒸留を実行しているとのこと。Frontier Model Forumは敵対的蒸留攻撃の手法を文書化することで、AI業界全体に責任あるモデル利用に関する共通規範を広め、効果的な保護策の開発に役立てることを目指しています。

Adversarial Distillation – Frontier Model Forum

https://www.frontiermodelforum.org/issue-briefs/issue-brief-adversarial-distillation/

この記事のタイトルとURLをコピーする