多くの人工知能(AI)と同じく、「Microsoft Copilot」はユーザーのことをできるだけ学習しようとする。チャットを適切にパーソナライズするためだ。そこでCopilotは、会話の履歴やユーザーが意図的に共有した情報を記憶している。だが、Copilotのある設定によって、ユーザーの知らないうちに他のMicrosoft製品からもデータが取り込まれている可能性がある。

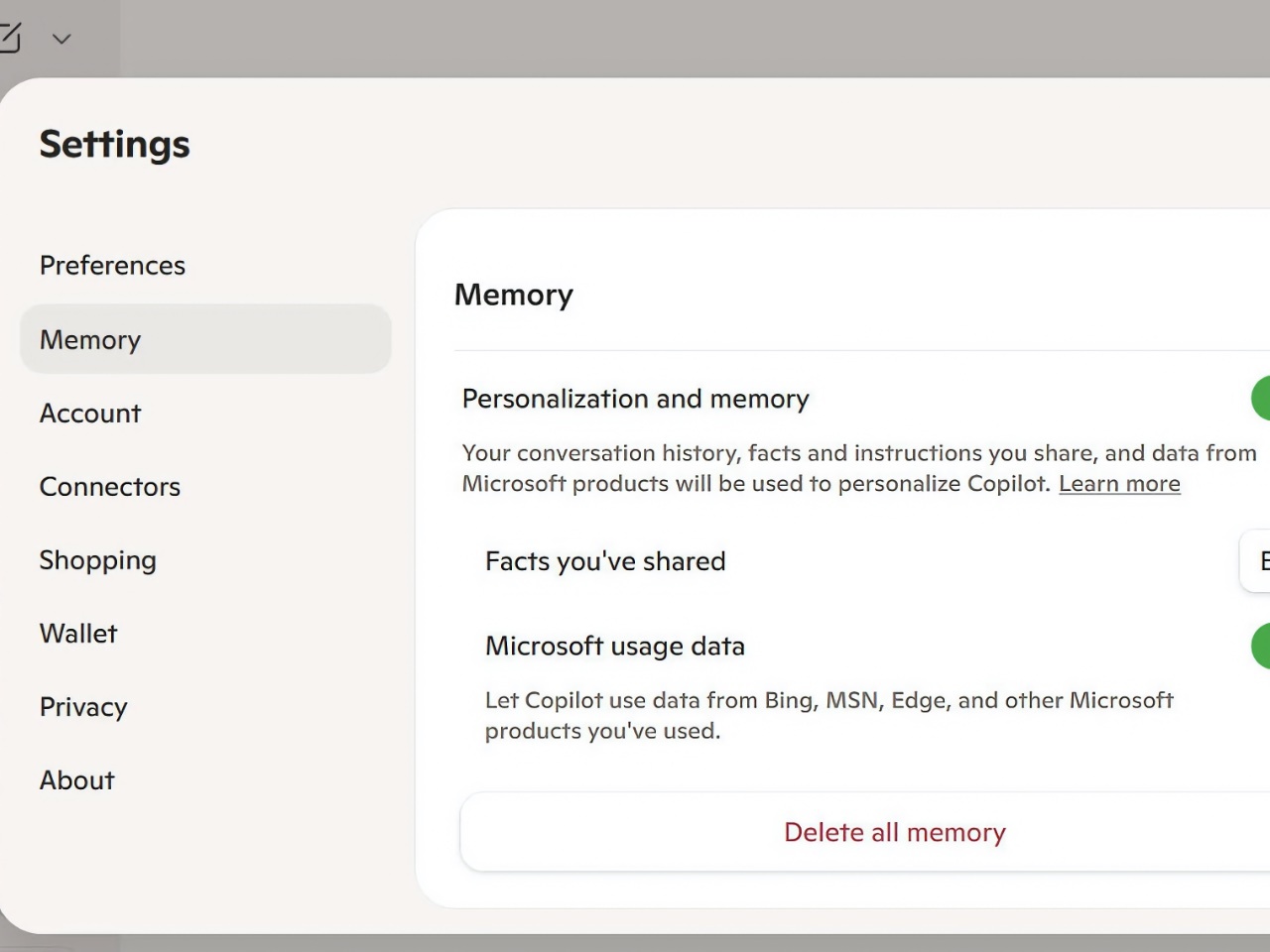

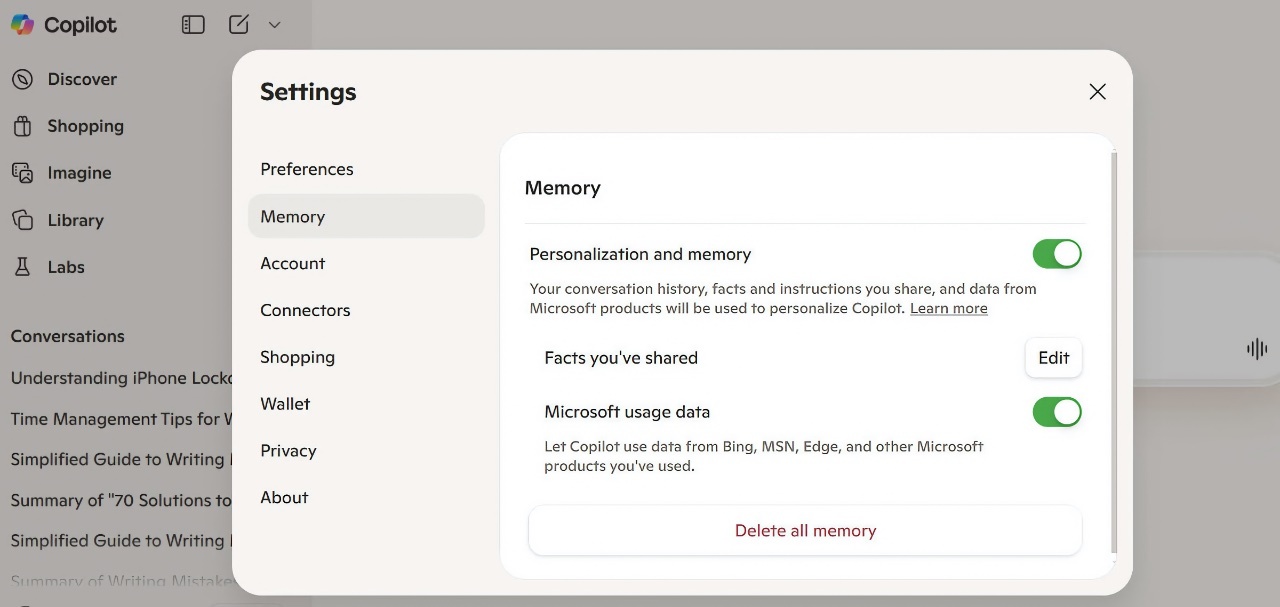

「Microsoftの使用データ」と呼ばれるこの設定により、Copilotはユーザーが使用している「Bing」「MSN」「Edge」といったMicrosoft製品のデータを参照できるようになると、Windows Latestは報じている。Copilotのウェブサイトやモバイルアプリからアクセスできるこの設定は比較的最近追加されたようで、Copilotの「メモリ」オプション内に存在する。このオプションのおかげで、Copilotは会話の履歴や、ユーザーが共有した事実や指示だけでなく、Microsoft製品から一部のデータを呼び出して、パーソナライズ目的で使用できる。

プライバシーが危険にさらされているのか?

MicrosoftはCopilotに関するFAQの中で、プライバシーステートメントに記載されている限定的な目的でのみ会話を利用すると約束している。つまり、Copilotのパフォーマンスの監視、問題のトラブルシューティング、不具合の診断、不正利用の防止、および製品の改善のためにのみ、データが記録されるということだ。また、ユーザーの情報をAIモデルのトレーニングに利用することはないと、同社は述べている。実際、トレーニングに関する設定は別に存在しており、ユーザー自身で無効にできる(無効にすべきだ)。

さらに、Copilotのパーソナライズ設定は、ターゲティング広告を受け取るかどうかを管理するものではない。それも別のオプションとなっており、Microsoftアカウントのページにサインインし、「プライバシー」から「パーソナライズされた広告の設定」セクションにアクセスすれば無効にできる。

それでも、プライバシーへの懸念を抱くのは当然だろう。Copilotの別のFAQによれば、パーソナライズのオプションが自動で有効になっている可能性があるからだ。実際、筆者が自分のPCでCopilotを確認したところ、これらの設定は有効になっていた。Copilotに質問する内容が自分に関する知識を必要としないのであれば、このオプションを無効にした方が良さそうだ。

Screenshot by Lance Whitney/ZDNET

この記事は海外Ziff Davis発の記事を4Xが日本向けに編集したものです。