NVIDIAが自社でトレーニングした推論モデル「Llama Nemotron Super 49B v1.5」を公開しました。Llama Nemotron Super 49B v1.5は中国製AIモデルの「Qwen3 235B」と「DeepSeek R1 671B 0528」の出力をもとに追加学習が行われており、49B(490億)という比較的少ないパラメーター数ながら高い性能を備えていることを特徴としています。

Build More Accurate and Efficient AI Agents with the New NVIDIA Llama Nemotron Super v1.5 | NVIDIA Technical Blog

https://developer.nvidia.com/blog/build-more-accurate-and-efficient-ai-agents-with-the-new-nvidia-llama-nemotron-super-v1-5/

Llama Nemotron Super 49B v1.5はLLaMAシリーズのモデルに対して追加学習を施して高度な推論機能などを追加したモデルです。追加学習には、Qwen3 235BとDeepSeek R1 671B 0528を用いて生成した2600万行超えのデータセットが用いられています。データセットには「関数呼び出し」「命令の追跡」「推論」「チャット」「数学」「コードデータ」といった情報が含まれています。

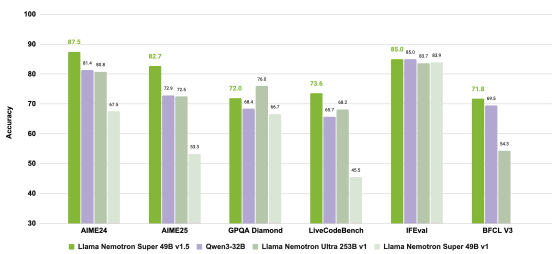

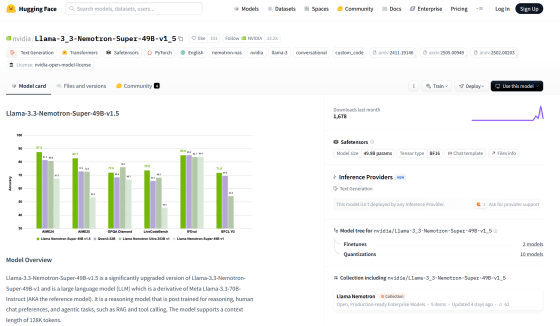

以下のグラフは「Llama Nemotron Super 49B v1.5」「Qwen3-32B」「Llama Nemotron Ultra 253B v1」「Llama Nemotron Super 49B v1」の各種ベンチマークスコアを並べたものです。Llama Nemotron Super 49B v1.5は前世代モデルやQwen3-32Bを超える性能を示しているほか、より大規模なモデルであるLlama Nemotron Ultra 253B v1のスコアをほとんどのテストで上回っています。

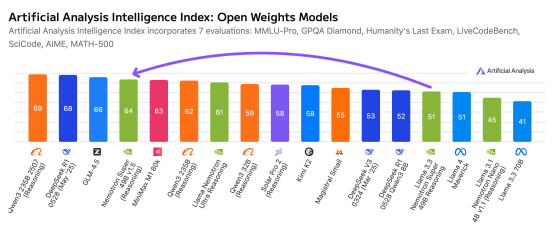

AIの性能比較サイトであるArtificial AnalysisもLlama Nemotron Super 49B v1.5の性能検証結果を公開しています。Artificial Analysisの分析結果によると、Llama Nemotron Super 49B v1.5は「QWen3 235B」「KimiK2」「Magistral Small」といったオープンモデルよりも高い性能を示したとのこと。

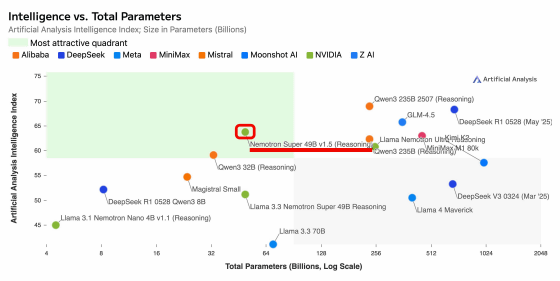

以下のグラフは縦軸がAIモデルの性能、横軸がパラメーター数を示しています。Llama Nemotron Super 49B v1.5が小規模かつ高性能なモデルであることが分かります。

Llama Nemotron Super 49B v1.5は以下のリンク先で公開されています。また、追加学習に使われたデータセットも数週間以内に公開される予定です。

nvidia/Llama-3_3-Nemotron-Super-49B-v1_5 · Hugging Face

https://huggingface.co/nvidia/Llama-3_3-Nemotron-Super-49B-v1_5

この記事のタイトルとURLをコピーする