ゲームのVRAM消費量は過去5年間で指数関数的に増え続けてきた。4K解像度のテクスチャが当たり前になり、PBR(物理ベースレンダリング)マテリアルが複数チャンネルのデータを積み重ねるなか、GPUメーカーは消費者向け製品のVRAM容量を抑制しつつ、上位モデルとの差別化を維持してきた。RTX 3060が12GBを搭載していたのに対し、RTX 4060とRTX 5060が8GBに留まったのはその典型だ。現行のテクスチャ圧縮技術が前提とする「多く積めば多く使う」という構造が変わらない限り、この路線はゲーマーへの不満を蓄積させ続ける。

GTC 2026でNVIDIAが改めて詳細を公開したNeural Texture Compression(NTC)は、この前提そのものに切り込む技術だ。Tuscan Villaシーンのデモでは、従来のBCN(Block Compressed N-format)テクスチャが6.5GBのVRAMを消費していたのに対し、NTCを適用すると同一シーンのテクスチャが970MBに収まった。削減率にして約85%、容量比では約6.7分の1だ。目視では違いをほぼ判別できないとNVIDIAは示している。

BCNの限界と、なぜ今テクスチャ圧縮が問い直されるのか

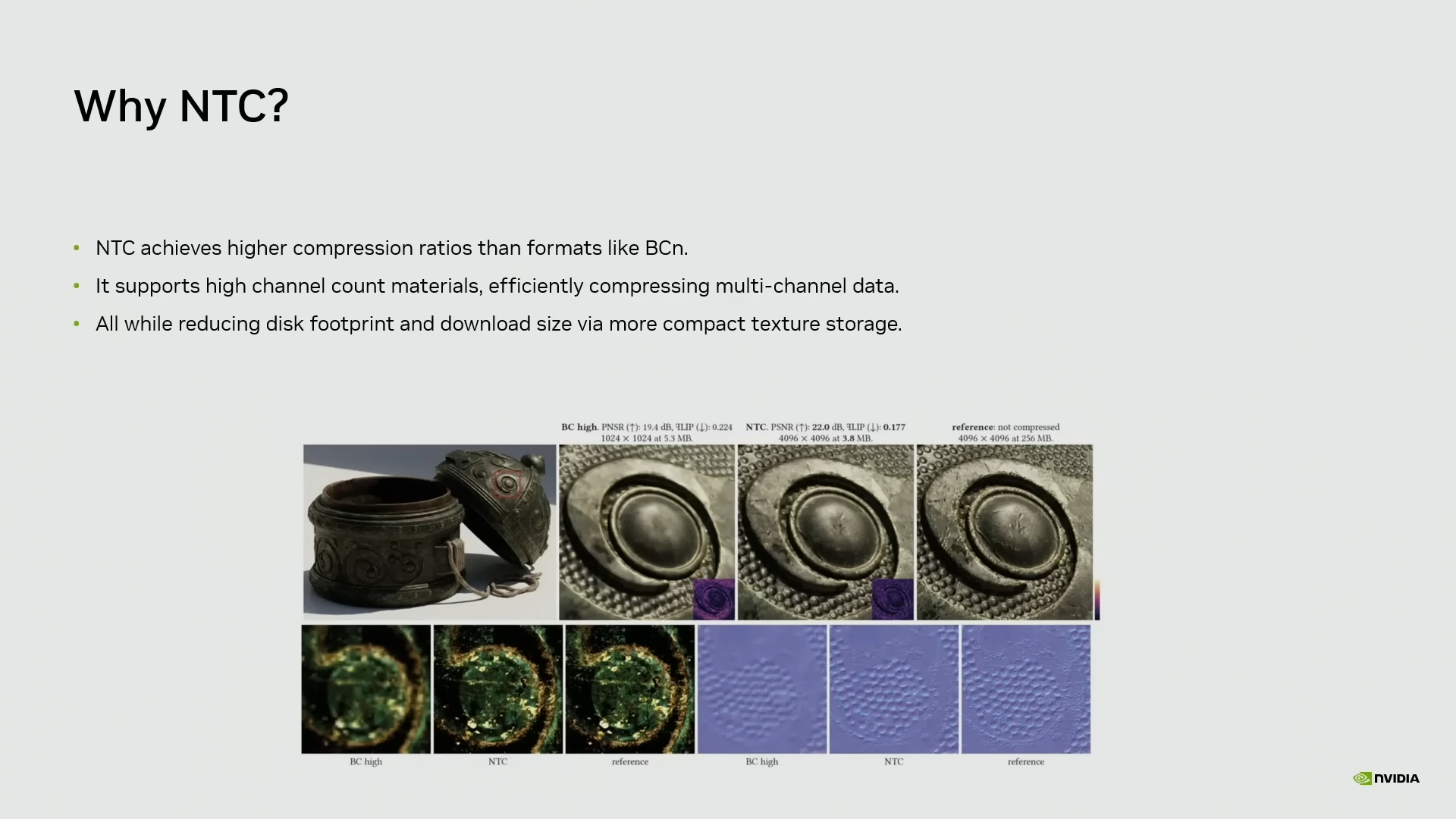

従来のテクスチャ圧縮規格であるBCN(BC5、BC6、BC7など)は、4×4ピクセルのブロック単位で色情報を近似する固定フォーマット型の圧縮方式だ。GPUはこのブロック圧縮データをビデオメモリから直接読み出し、シェーダー処理を行う。この方式の長所は、ハードウェアで高速に展開できる予測可能性にある。しかし欠点は明白で、圧縮率には上限があり、マテリアルが多チャンネルのデータ(法線マップ、粗さ、アルベド、アンビエントオクルージョンなど)を持つほど、VRAM使用量は膨張する一方となる。

ゲームタイトルの視覚的な複雑さが増すにつれ、BCNが生み出すブロックノイズ(アーティファクト)と、増え続けるメモリ圧迫という二重の問題が顕在化している。特に4K環境では、テクスチャの解像度を落とさざるを得ないケースや、ストリーミングの頻度が上がることによるパフォーマンス低下が発生していた。NTCが目指しているのは、この固定フォーマットという構造的な制約を、機械学習の手法で根本から迂回することだ。

Neural Texture Compressionのしくみ:決定論的な再構築

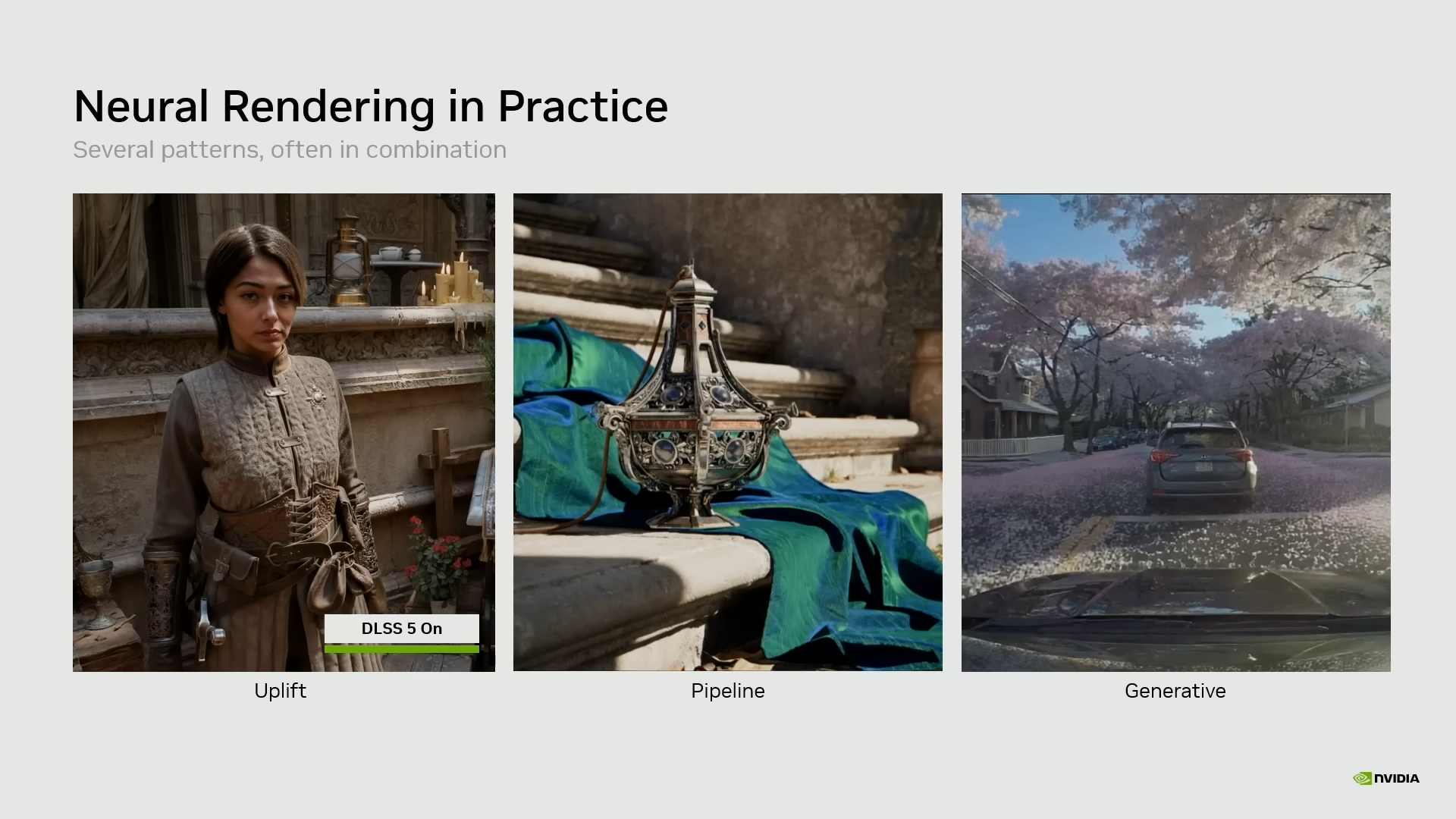

GTC 2026のセッション「Introduction to Neural Rendering」でNVIDIAのシニアDevTechエンジニアAlexey Bekin氏が技術的な詳細を説明した。NTCのアーキテクチャは、大きく分けて二つの要素から成る。

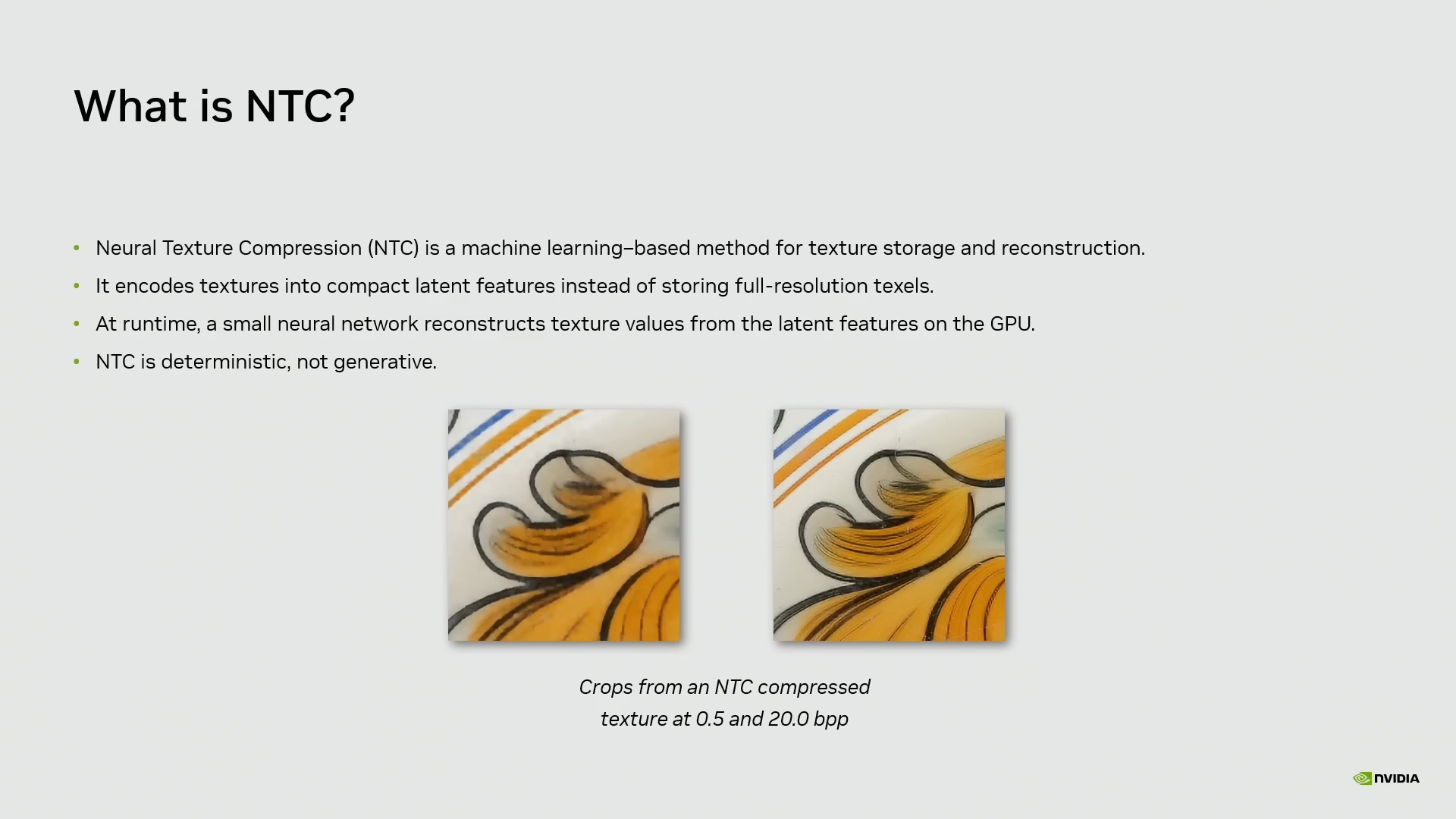

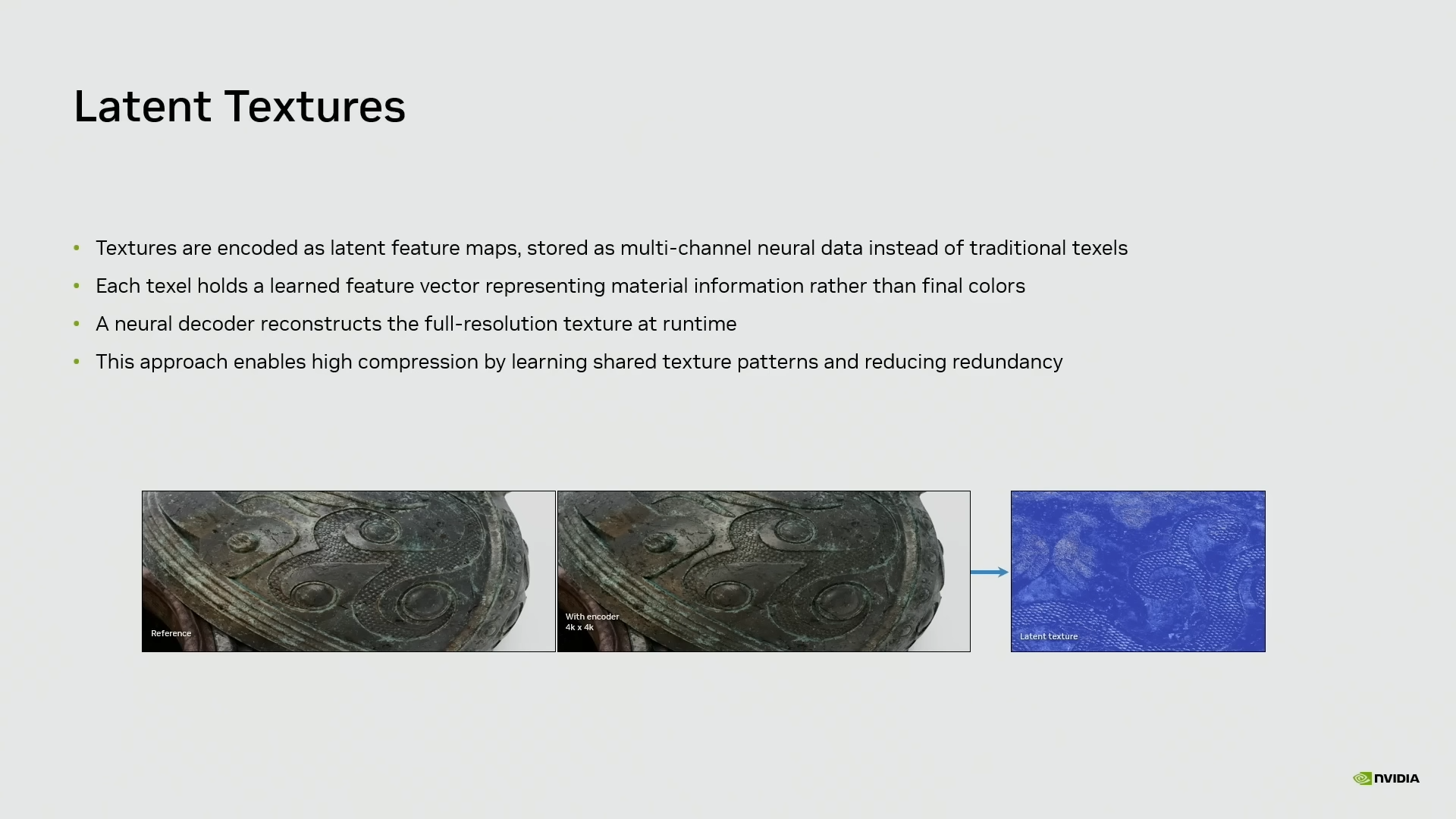

ひとつは「潜在テクスチャ(Latent Texture)」だ。個々のテクセル(テクスチャの基本単位)の色情報をそのまま保存するのではなく、マテリアルの本質的な視覚特性を凝縮した低次元の「潜在特徴ベクトル」として格納する。これにより、ディスク上のデータサイズは劇的に縮小する。元が272MBの無圧縮テクスチャは、BCN圧縮で98MBになるが、NTCではわずか11.37MBまで落とせるという(元の約24分の1)。

もうひとつは「ニューラルデコーダ」だ。ゲームの実行時に、GPU上で動作するMLP(多層パーセプトロン)が潜在特徴とUV座標を入力として受け取り、テクセル値をオンデマンドで復元する。このとき重要なのが「位置エンコーディング(Positional Encoding)」であり、UV座標に高周波情報を付加することで、繰り返しパターンや微細なディテールを精度高く再現できる。

そして、この技術の実用上の根幹となる特性が「決定論的(Deterministic)」な動作だ。NTCは生成AIと異なり、同一の潜在特徴と重みから毎回全く同じテクスチャを再構築する。確率的なサンプリングに依存するDiffusionモデルや大規模言語モデルとは本質的に異なる仕組みであり、ゲーム開発が必要とする「いつでも同じ画像が出る」という一貫性を保証する。コミュニティで懸念されてきた「AIが毎回異なる画像を生成してしまう」という問題とは無縁の技術設計だ。

Neural Materialsとの組み合わせ:バンド幅とレンダリングコスト双方に作用

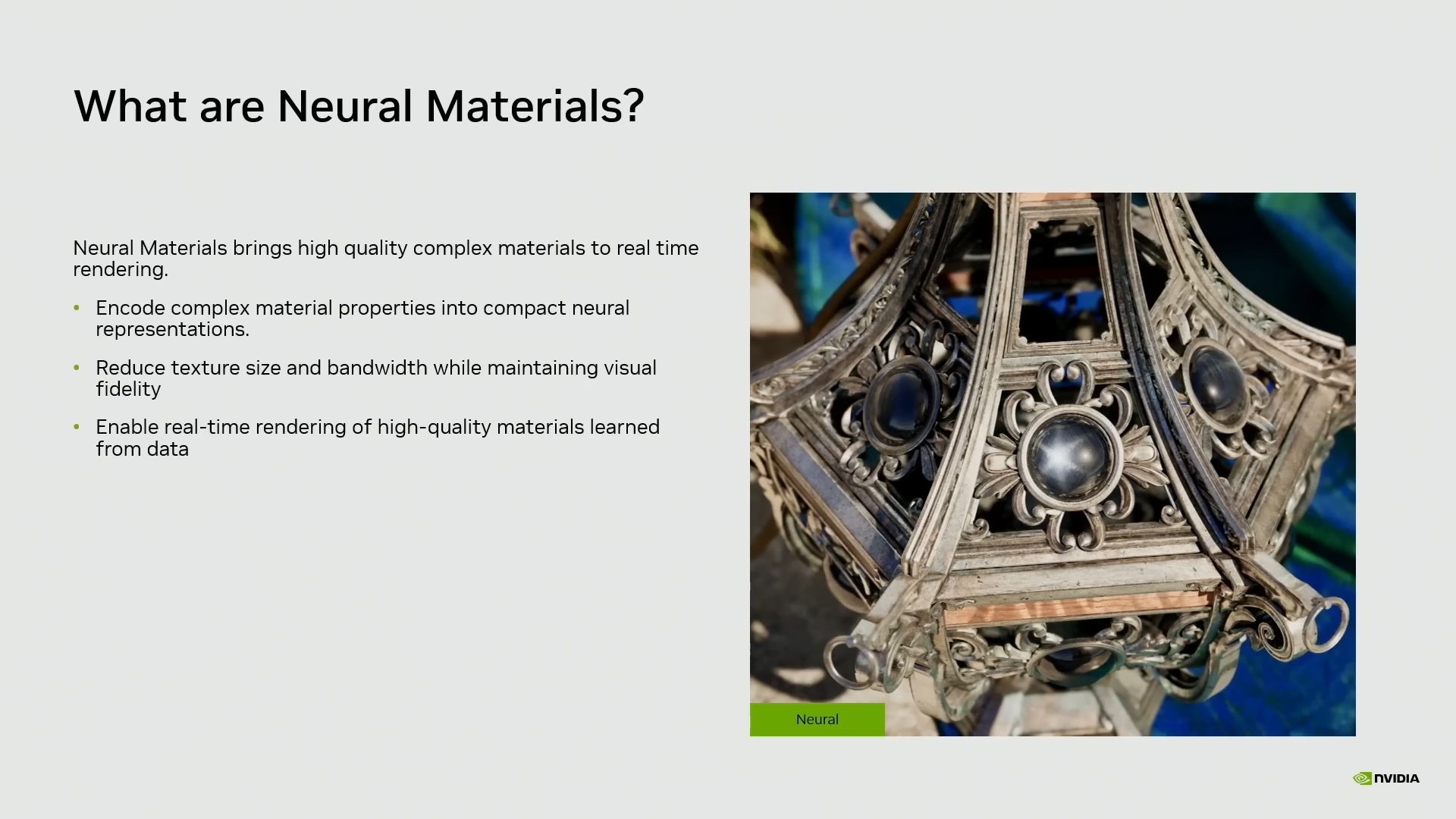

NVIDIAはNTCと並んで「Neural Materials」も同セッションで紹介している。こちらはテクスチャの圧縮ではなく、マテリアルの「振る舞い」そのものを圧縮する手法だ。

現実世界の複雑なマテリアル(セラミックの釉薬、金属蒸着、多層コーティングなど)を伝統的なBRDF(双方向反射率分布関数)で計算する場合、法線マップ、粗さ、アルベドなど複数のテクスチャを読み出した上で、光の角度と材質の相互作用を逐次計算する必要がある。この処理コストは、マテリアルの複雑さに比例して増加する。

Neural Materialsでは、この複数テクスチャの読み出しとBRDF計算を「学習済みの応答」に置き換える。デモシーンでは19チャンネルのマテリアルデータを8チャンネルの潜在表現に圧縮し、1080p環境での描画速度が1.4倍から7.7倍に向上した。テクスチャルックアップと方程式の逐次評価が、単一の効率的な行列演算パスに置き換わるからだ。この計算はいずれもTensor Coreで処理されるため、通常のシェーダー演算の性能予算とは独立して動作する。

ハードウェアの非依存性という構造問題

NTCが純粋に技術的な観点では優れていても、エコシステムへの普及という観点では複雑な課題を抱えている。

NTCを支えるコアの仕組みは、GPU内部に搭載された行列演算エンジンだ。NVIDIAはこれをTensor Core、IntelはXMXエンジン、AMDはAIアクセラレータと呼んでいる。MicrosoftとNVIDIAが協力してDirectXに「Cooperative Vectors」として統合したことで、NTCの概念はAPIレベルでのクロスプラットフォーム化が進みつつある。IntelもすでにNTC関連のデモを実施しており、AMDは2024年に自社の取り組みを発表している。

しかし、NTCの恩恵が実際にどのハードウェアに及ぶかは均一ではない。テクスチャ復元の行列演算をリアルタイムで処理するには、行列演算エンジンの演算能力が不可欠であり、その性能はハードウェア世代やアーキテクチャによって大きく異なる。RTX 40/50シリーズはこの用途に最適化されているが、旧世代や競合GPU上での動作効率は製品ごとの実装次第になる。標準化は進んでいても、「すべてのGPUで同等に動く」状態にはまだ届いていない。

また、NTCのSDKはGitHub上でベータ公開されている(https://github.com/NVIDIA-RTX/RTXNTC)にもかかわらず、現時点でNTCを採用したゲームタイトルは一本も存在しない。技術自体は約3年前から存在しており、2026年初頭にSDKが正式リリースされた段階でも、ゲームデベロッパーの実装事例はゼロだ。NVIDIAがGTC 2026で改めてデモを行ったのも、この普及の遅れを意識したからだろう。

PlayStation 6との接続:Sonyが採用を検討しているとされる理由

このコンテキストで注目に値するのが、情報リーカーKepler_L2が伝えた情報だ。Sonyが次世代機PlayStation 6においてNTCを採用し、1TBのSSDコストを抑えながらゲームのインストールサイズを縮小する方向で検討しているという。

これは技術選択として理にかなっている。NTCはディスク上のデータサイズも大幅に削減するため、ゲームのダウンロード容量やパッチサイズへの直接的な影響がある。コンシューマー向けSSDの容量拡張はコストを伴うが、NTCが広く採用されれば同じ1TBでもより多くのコンテンツを収容できる。DualSenseのような体感型ハードウェア機能と並んで、PlayStation 6がメモリ効率面での工夫でプラットフォームの価値を打ち出すなら、NTCは有力な手段のひとつになる。

ただし、PlayStation 6にはAMD製GPUが搭載される見通しであり、AMD側のNTC実装状況が鍵を握る。AMDは2024年に「Neural Texture Block Compression」への取り組みをロンドンで発表したが、2026年4月時点で製品への組み込みに関する具体的な情報は出ていない。DirectXのCooperative Vectorsという共通基盤が整備されていることは、AMD製ハードウェアへの展開に向けた技術的な下地にはなる。ただし共通APIがあることと、実際のゲームパイプラインへの最適化実装が完成することの間には、相当な距離がある。PlayStation 6向けにNTCが機能するためには、Sonyとの密接な共同開発が必要になる局面も想定される。

DLSS 5騒動との対比:生成AIとの本質的な違い

NTCをめぐる議論は、同じGTC 2026で発表されたDLSS 5への反応とは対照的だ。DLSS 5はYouTube上で公開直後から84%の「低評価」を集め、「AIスロップ」というレッテルを貼られた。ゲーマーやデベロッパーの一部が懸念したのは、AIモデルがレンダリングの最終段階で画像を書き換え、ゲームの視覚的な意図や「絵作り」を損なう可能性だった。Jensen Huang氏がこの批判に対して「ゲーマーは完全に間違っている」と反論したことで、さらに論争が広がった。

この騒動があるからこそ、NTCに対して「これも生成AIによる画像加工なのでは」という誤解が生まれやすい状況があった。しかし実際には、NTCはDLSS 5とは根本的に異なる技術だ。DLSS 5は最終出力画像を再構成するが、NTCはテクスチャデータの保存形式と読み出し方を変えるだけで、ゲームのアート方向性には一切介入しない。Bekinが明言したように、NTCは決定論的なシステムだ。ゲーム開発者が定義したテクスチャが、より少ないメモリで保持・復元されるだけであり、出力内容をAIが上書きするわけではないのだ。

Tom’s HardwareのHassam Nasir氏はこの点を的確に整理している。「NTCはAIの良い使い方のひとつだ。生成的ではなく、ゲーム開発中に特定のテクスチャセットのみで訓練されるため、ハルシネーションの余地がない」

8GBのVRAMは時代遅れではなくなるか

NTCの実用化は、GPU購入の議論にも影響を与えうる。RTX 4060(8GB)やRTX 5060(8GB)は、VRAM容量を理由に高解像度・高品質設定では力不足という評価を受けてきた。しかしNTCが広く採用された世界では、同じ8GBでより多くのテクスチャデータを扱えるようになる。

より正確に言えば、VRAM 8GBという容量の「意味」が変わる。現在の8GBは、BCN圧縮されたテクスチャを6.5GBが食いつぶす可能性があるという前提の上に成立している。NTC適用後の同シーンでは970MBしか使われないとすれば、残りの7GB超が他のゲームコンテンツや処理に割り当てられる余裕が生まれる。NVIDIAがRTX 5060に8GB搭載を決定した背景にも、こうした技術ロードマップへの自信があった可能性がある。

ただし、デベロッパー採用という変数が依然として最大のボトルネックだ。どれだけ効率的な技術でも、ゲームタイトルに実装されなければゲーマーには届かない。NTCが今後の標準的なゲームワークフローに組み込まれていくかは、SDKの使い勝手、ゲームエンジン(Unreal Engine、Unityなど)との統合度、そしてNTCのコーナーケースに対するデベロッパーの信頼感にかかっている。

Slang言語はこの障壁を下げる重要な要素になりうる。NVIDIAが開発したShader言語Slangは、CUDAだけでなくHLSLやGLSLにもコンパイルでき、各プラットフォームの行列演算APIに直接アクセスできる。研究段階のコードをそのままプロダクションに持ち込めるという特性は、NTCをゲームパイプラインに組み込む際の開発コストを大幅に低減する。これが機能すれば、NTCのSDKとSlangの組み合わせによって、実装の敷居は想定より低くなる可能性がある。

テクスチャはゲーム内で最もVRAMを消費するカテゴリだ。そのカテゴリで85%削減が実証されたという事実は、GPUスペック表から「VRAM容量」という数字の持つ意味をずらしていく。容量の絶対値で優劣を語る時代から、同じ容量でどれだけのコンテンツ密度を扱えるかという時代への移行——それはNVIDIAにとって都合のよい語り口だが、NTCの仕組みそのものが正しければ、その語り口には根拠がある。問題は、デベロッパーがそれを実感するタイトルが出てくるまでに、どれだけ時間がかかるかだ。

Sources