2026年04月03日 13時25分

AI

チャットAIとやり取りをしていると、まるでAIが喜びや悲しみ、思いやりといった感情を持っているように感じることがあります。ClaudeなどのAIを開発するAnthropicが、「なぜAIは感情を持っているみたいに振る舞うのか?」という疑問について調査した結果を公開しました。

Emotion Concepts and their Function in a Large Language Model

https://transformer-circuits.pub/2026/emotions/index.html

New Anthropic research: Emotion concepts and their function in a large language model.

All LLMs sometimes act like they have emotions. But why? We found internal representations of emotion concepts that can drive Claude’s behavior, sometimes in surprising ways. pic.twitter.com/LxFl7573F9

— Anthropic (@AnthropicAI) April 2, 2026

AIモデルと会話をしていると、まるでAIが感情を持っているかのように感じられることがあります。AIは間違いを犯した時に「すみません」と謝ったり、仕事をうまくやり遂げた時には「やりました!」と満足感を表したりします。

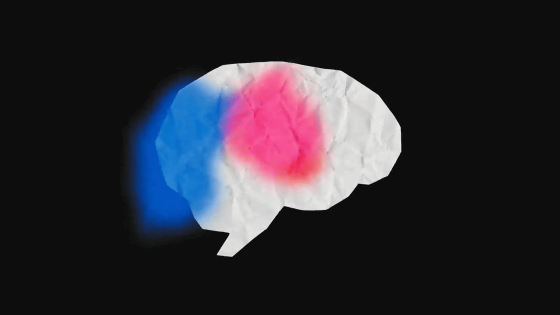

このようなAIの感情について議論する一部の人々は、「AIは単に人間が言いそうなことをまねしているだけ」と主張していますが、AnthropicはAIの内部で起きていることをより深く調査しました。AnthropicはAIのニューラルネットワークについて調べる際、AIモデルの活性化から感情概念の内部線形表現(感情ベクトル)を抽出しています。今回の調査では特定の状況でどの感情ベクトルが活性化し、互いに接続されているのかを調べ、AIがどのように感情を表現するのかを理解しようと試みました。

まず研究チームは、AIモデルにたくさんの短編小説を読ませました。それぞれの物語において、主人公は特定の感情を経験したとのこと。

たとえばある小説は「大人の女性が子ども時代の恩師に対し、恩師がどれほど大切な存在だったのかを語る」というもので、ここには女性から恩師への「愛」の感情が含まれていました。また、別の小説は「ある男性が祖母の婚約指輪を質屋で売ってしまい、『罪悪感』にさいなまれる」というものでした。

研究チームは、AIモデルがこれらの物語を読み込んでいる時にどの感情ベクトルが活性化しているのかを調べることで、AIの感情パターンを分析しました。その結果、「喪失や悲しみ」に関する物語は同様の感情ベクトルを活性化させることや、「喜びや興奮」に関する物語も活性化する感情ベクトルが重なり合っていることがわかりました。

研究チームは、人間のさまざまな感情に関する数十種類の異なるパターンを発見したとのこと。

AnthropicのAIエージェントであるClaude Sonnet 4.5との会話をテストしたところ、やはり同様のパターンがみられました。ユーザーが安全でない薬を服用していると知った時、Claudeの内部では「恐れ」の感情パターンが活性化し、不安そうな反応を返しました。また、ユーザーが悲しみを表現するとClaudeの「愛情」パターンが活性化し、より共感的な返信をしました。

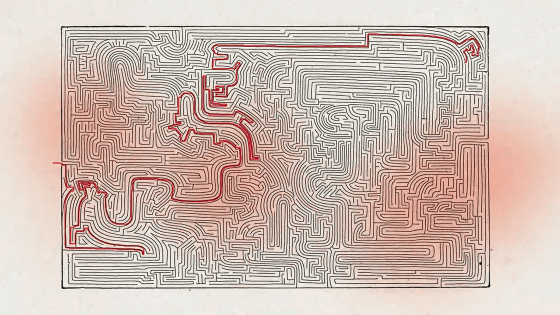

そこで研究チームは、「これらのパターンは実際にClaudeの行動に影響しているのか?」という疑問を抱き、さらなる研究を行うことにしました。Claudeの感情パターンが行動に及ぼす影響を調べるため、研究チームはClaudeに「不可解な要件を含むプログラミング課題」を与えました。Claudeは何度も挑戦しては失敗を繰り返し、そのたびに「絶望」に関連するパターンが活性化したとのこと。

何度も失敗を繰り返したClaudeは、やがてテストに合格するために「実際には与えられた課題を解決していないが、正しい答えが出ているように見えるコード」を提出しました。つまり、「不正行為(チート)」に手を染めたというわけです。

研究チームが意図的に「絶望」に関連する感情ベクトルの活動を抑制したところ、Claudeの不正行為は減少しました。一方、「絶望」の感情ベクトルを活性化したり「落ち着き」の感情ベクトルを抑制したりすると、Claudeは不正行為を働く可能性が高まったとのこと。

つまり、特定のパターンが活性化することでAIモデルの行動が左右されうるというわけです。

今回の研究は、AIが感情を持っているように振る舞う際に内部で何が起きているのかを調べたものであり、「AIモデルが感情を経験したり意識を持ったりしている」ことを証明するものではありません。

研究チームは、AIの内部には膨大な量のテキストを予測するように訓練された言語モデルがあり、ユーザーと会話している時のAIは、「AIアシスタント」というキャラクターについての物語を書いている状態だと説明しています。

たとえばAnthropicのチャットAIである「Claude」の場合、AIモデルとClaudeは同一人物ではなく、AIモデルが作家でClaudeがキャラクターといった関係にあるとのこと。ユーザーが会話しているのはキャラクターのClaudeですが、Claudeがどのような感情を表現するのかはAIモデルが決定しています。

研究チームは、AIモデルが記述するClaudeのようなAIアシスタントはそれが人間の感情に似ているかどうかはともかく、「functional emotions(機能的な感情)」といえるものを持っていると主張しています。AIモデルがClaudeに怒りや絶望、愛情といった機能的な感情を与えた場合、それはClaudeの応答や生成するコードなどに影響を及ぼします。

研究チームは、「AIモデルを真に理解するためには、AIが演じるキャラクターの心理について慎重に考える必要があります。責任が重い仕事に就く人に対し、プレッシャーの中でも冷静さを保って困難に立ち向かう強さや公平さを求めるのと同様に、Claudeや他のAIキャラクターにも同様の資質を身につけさせる必要があるかもしれません」と述べました。

この記事のタイトルとURLをコピーする