Arm Holdingsは2026年3月24日、同社創業35年以上の歴史で初となる自社設計チップ「Arm AGI CPU」を発表した。ArmはこれまでチップのIPをApple、NVIDIA、Google、Amazonといった大手企業に提供し、ロイヤルティを受け取るビジネスモデルで世界的な地位を確立してきた企業だ。今回はその構造を根本から変える転換で、Armは実際のシリコン製品を販売するメーカーとしての側面を新たに持つことになる。

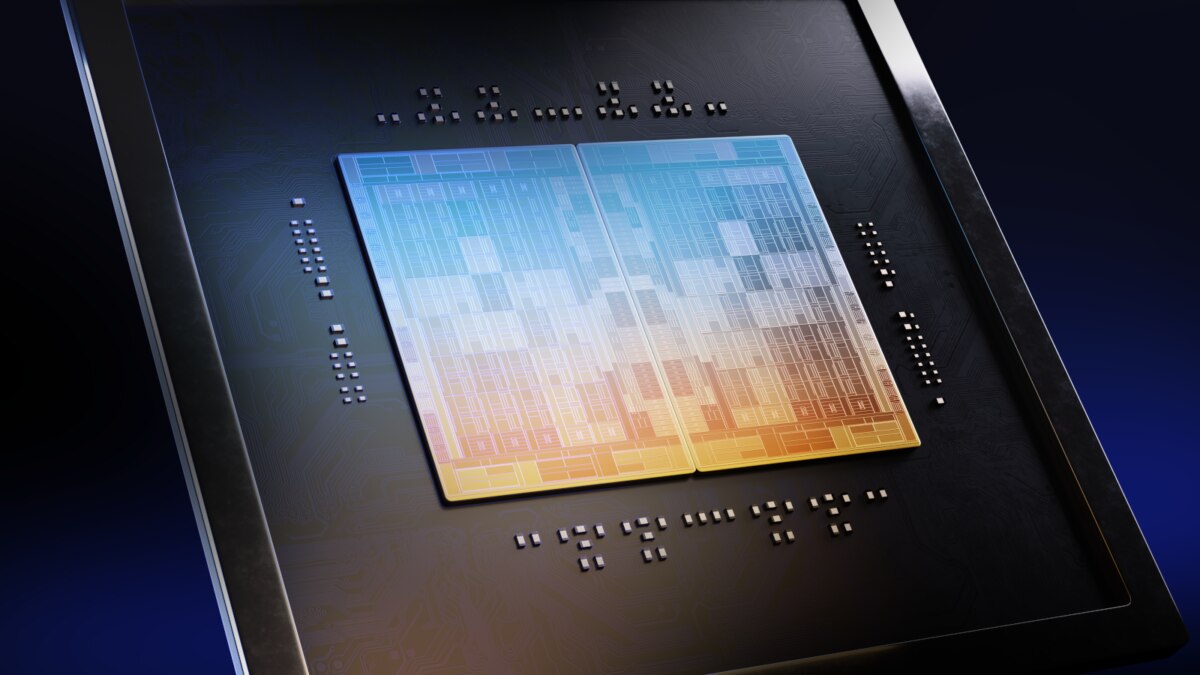

136コアのNeoverse V3アーキテクチャを採用し、TSMC(台湾積体電路製造)の3nmプロセスで製造される同チップは、エージェントAI(タスクを自律的に実行するAIシステム)向けデータセンターを主な市場として設定しており、MetaをリードカスタマーにOpenAI、Cloudflare、SAP等8社の初期パートナーが名を連ねる。

エージェント型AIがCPU不足を生んだ、インフラ構造の変化

エージェント型AIの台頭は、データセンターでのCPUの役割を根本から変えつつある。GPUが並列処理で大量のデータを一気に扱う一方、CPUはアクセラレーターの調整、ワークロードのスケジューリング、ネットワーク管理、データ移動といった制御タスクを担う。エージェントシステムが数百から数千のAIモデルを並行して動かす環境では、このオーケストレーション役のCPUがボトルネックとして浮上し、NVIDIAのCEO、Jensen Huang氏も2026年3月のGTCカンファレンスで「CPUがAIインフラのボトルネックになりつつある」と公言しており、CPUの地位回復はArmだけが見ている局面ではない。

Arm NeoverseプラットフォームはすでにAWS Graviton、Google Axion、Microsoft Azure Cobalt、NVIDIA Veraといった主要クラウド・AIチップの基盤として採用されているが、これらはいずれも各社がArmのIPを用いて独自設計したチップだ。Arm AGI CPUはその一段先の選択肢であり、独自チップ設計のリソースを持たない企業でも生産対応済みのArm CPUを即座に展開できる。Arm EVP(クラウドAI担当)のMohamed Awad氏は「エコシステム全体がArmに対してより多くのことを求めている」と述べており、Armはその需要に直接応える製品としてAGI CPUを位置づけている。Futurum Groupは2028年までにCPU市場の成長率がGPUを上回る可能性があると予測しており、Armの参入タイミングはこの市場変化を見越した判断だ。

Armがこのステップに踏み切った背景には設備投資の裏付けもある。テキサス州オースティンのキャンパスに約7,100万ドル(約110億円)と18ヶ月を投じて3つのチップ検証ラボを建設し、かつて数十人規模だったチームは今や1,000名超に成長した。CNBCの独占取材でMohamed Awad氏がこのラボ施設を公開しており、Armが単なる発表にとどまらず実際の量産検証体制を整備してきたことが確認できる。

AGI CPUのスペック:エージェント型AI向けに削ぎ落とした設計

AGI CPUの設計思想は「余計な機能を載せない」ことに徹している。Awad氏はThe Registerの取材で「レガシーアプリのサポートなど、このチップの使命に100%使われない機能は意図的に搭載しなかった。これはクリーンシートな設計だ」と説明している。NVIDIAのVera CPUがSMT(同時マルチスレッディング)を採用するのに対し、Arm AGI CPUは1コア1スレッドに絞っており、決定論的なパフォーマンス・スケーリングを優先した構成だ。

主要スペックは以下の通りだ。

項目仕様コアアーキテクチャArm Neoverse V3(Armv9.2 ISA)コア数最大136コア動作周波数最大3.7GHz(全コア3.2GHz)L2キャッシュ2MB/コアシステムレベルキャッシュ(SLC)128MB製造プロセスTSMC 3nm(N3P)TDP(熱設計電力)300Wパッケージデュアルチップレット(コンピュートとメモリ/IOが同一ダイ)メモリ規格DDR5(最大DDR5-8800、12チャンネル)メモリ容量最大6TB/チップメモリ帯域幅800GB/s以上(コアあたり6GB/s)メモリレイテンシ100ns以下I/O96レーン PCIe Gen6メモリ拡張CXL 3.0(メモリ拡張・プーリング対応)チップ間インターコネクトAMBA CHI拡張リンクSMT(同時マルチスレッディング)非対応(1コア1スレッド)

メモリアーキテクチャには独自の工夫が施されており、12チャンネルのDDR5(1ダイあたり推定6チャンネル)を搭載しており、コンピュートダイとメモリ・IOダイを同一ダイに集積するチップレット設計が100ns以下のレイテンシを実現している。このアーキテクチャでは、OSが各ダイを独立したNUMA(Non-Uniform Memory Access)ドメインとして認識するため、ソフトウェアのNUMA対応が前提条件となる。x86 CPUが重負荷時にコア間競合で性能が低下する傾向を、広いメモリ帯域幅と高効率なシングルスレッド設計の組み合わせで解消しようとするアプローチだ。

1ラックに8,160コアを詰め込む高密度設計と、x86・NVIDIAとの比較

リファレンスサーバーは1OU(Open Unit)デュアルノード構成で、1台のシャーシに2つのノードを収め、ブレード1枚あたり272コアを提供する。Armはこの1OU設計を軸に2種類のラック構成を検証・公開しており、空冷から大規模液冷まで対応できる体制を整えた。液冷バリアントはSupermicroとの共同設計で、より高いコア密度を優先した大規模インフラ向けの構成だ。

構成冷却方式ラック電力ブレード/サーバー数AGI CPU数総コア数標準ORv3ラック空冷36kW30(1U×30)608,160大規模液冷ラック(Supermicro)液冷200kW42(8ノードサーバー)33645,696NVIDIA Vera ETL256(参考)液冷———22,528

NVIDIAのVera ETL256 CPUラックのコア数は22,528とされる。Arm液冷構成は45,696コアとその2倍超の密度であり、電力容量が限られるデータセンターにとって「1ラックあたりのコア数」という指標で明確な差が出る。空冷構成での性能についてArmは「同等のx86ベースシステム比で2倍以上」と主張しているが、これはArmの内部試算に基づくものであり、独立した第三者による検証結果ではない。サーバー製品の展開はASRockRack、Lenovo、Supermicroが担い、現時点で受注を開始している。リファレンスサーバーの詳細仕様は以下の通りだ。

項目仕様シャーシ1OU ORv3(W:537 × H:44.7 × D:805mm)搭載CPU2基(デュアルノード)メモリ(各ノード)12スロット DDR5 64GB 8000MT/sストレージ(前面)PCIe Gen5.0 E1.S × 各1.92TBPCIe拡張Gen6.0 x16スロット(前面・背面各1)ネットワークOCP NIC 3.0(各ノード1枚)電源ORv3 48V バスバー、定格1,100W冷却デュアルロータファン(19+1冗長構成)システム管理OCP DC-SCM 2.1、ASPEED AST2600 BMC準拠規格OCP DC-MHS、Arm SystemReady

MetaとOpenAIが加わる顧客陣と、NVIDIAとの新たな競合関係

MetaはAGI CPUのリードカスタマーとして2023年からArmとの共同開発に参加した。MetaのソフトウェアエンジニアPaul Saab氏はCNBCの取材で「Armとの最初の会話から『このチップを社内だけに留めず全世界で使えるものにしたい』と伝えていた」と述べており、Metaがサプライチェーンの多様化と供給安定を両立させる手段としてArm AGI CPUを位置づけていることが伝わる。MetaはNVIDIAやAMDからも大量調達しており、自社設計のMTIA(Meta Training and Inference Accelerator)最新世代も展開しているが、AGI CPUは「既存のCPUのドロップイン代替として透過的に使える」点を評価した形だ。

OpenAIの工業コンピュート担当Sachin Katti氏は「毎日数億人がChatGPTを使い、APIにはビジネスが依存している。AGI CPUはAIワークロードの大規模なオーケストレーション層の処理を担い、システム全体の効率と帯域幅を向上させる」とコメントしている。CloudflareのCSO(最高戦略責任者)Stephanie Cohen氏も「グローバルネットワーク全体で効率よくスケールするコンピュートが必要で、Arm AGI CPUはその要件を満たす」と述べており、CDN(コンテンツデリバリーネットワーク)・エッジ計算環境での展開も視野に入る。初期パートナー8社の顔ぶれはAI推論クラスタのCerebras・Rebellions・Positron、企業向けのSAP、通信事業者のSK Telecom、ネットワークセキュリティのF5と多岐にわたっており、AGI CPUの想定用途はエージェント型AIにとどまらない。

Armの今回の動きで最も微妙な立場になるのはNVIDIAだ。NVIDIAのGrace CPUもVera CPUも、ArmのIPを使って設計されたNeoverse V3ベースの製品であり、ArmはNVIDIAの最重要IPサプライヤーとして長年共存してきた。AGI CPUはそのNeoverse V3と同一アーキテクチャを採用しながら、ラック単位のコア密度ではVera ETL256を大幅に上回るとArmは主張しており、NVIDIAがArm製CPU市場の主要プレイヤーとしての地位を失いかねない局面でもある。Jensen Huang氏はArm発表イベントのビデオメッセージでArmを称賛したが、自社のGTC直後にこの競合製品が登場した事実は変えようがない。

Armが自社シリコンを持ったことで、IPライセンスのみに依存していた収益モデルに新たな柱が加わる。CPUの参入市場はAmpere Computingのみが非クラウドプレイヤーとして存在していた空白地帯でもあり、Armはそこに生産対応済みの製品を直接投入する形になる。今後はNeoverse CSS(コンピュートサブシステム)のIPロードマップと並行してAGI CPUの後継製品も開発を継続するとArmは明言しており、シリコン製品ラインとIPライセンスという2本立ての戦略が確立する。2026年の設備投資額が最大1,350億ドルに達するとされるMetaをはじめ、OpenAIやCloudflareといった企業がArm AGI CPUを選んだ。Armはもはや「半導体のスイス」として中立的なIPプロバイダーに徹する時代を終え、AIインフラの形を直接設計する側に立った。

Sources